목차

1. 신뢰성 설계가 제품 기능을 넘어서는 이유: Reliability Budget의 개념 정리

2. Failure Containment 전략: 실패를 격리하고 영향 반경을 통제하는 구조

3. 관측 가능성과 품질 신호의 연결: SLO, 운영 지표, 사용자 체감의 매핑

4. 데이터·모델·정책의 삼각 정렬: drift와 policy misalignment를 줄이는 방법

5. 실행 운영 프레임: 팀 구조, 의사결정, 개선 루프를 실무화하기

1. 신뢰성 설계가 제품 기능을 넘어서는 이유: Reliability Budget의 개념 정리

AI 에이전트 시스템을 설계할 때 가장 자주 발생하는 오해는 “기능이 충분히 잘 작동하면 신뢰성은 따라온다”는 믿음이다. 실제 운영 현장에서는 그 반대가 더 자주 벌어진다. 신뢰성은 기능의 부속물이 아니라, 기능이 움직일 수 있는 ‘예산’이자 경계선이다. Reliability Budget은 일정 기간 동안 시스템이 감수할 수 있는 실패량을 수치화한 개념이다. 예를 들어 30일 동안 99%의 task success가 목표라면, 실패 허용량은 1%다. 이 1%는 단순한 통계가 아니라 의사결정의 기준이 된다. When you spend the budget too fast, you must slow down feature rollout. 즉, 신뢰성 예산은 기능 출시 속도를 조절하는 브레이크다. 신뢰성 예산을 정의하지 않으면 팀은 ‘좋은 느낌’으로만 출시를 결정하게 되고, 그 결과는 운영 부채로 누적된다. 이러한 누적은 일정 규모를 넘는 순간 폭발처럼 나타나며, 사용자 신뢰를 단번에 무너뜨린다. Therefore the budget is not optional; it is the operating envelope of the agent.

Reliability Budget을 정하는 과정은 단순히 숫자를 합의하는 것이 아니라, “어떤 실패가 허용 가능한가”를 정의하는 과정이다. 예를 들어 추천 에이전트에서 근거 없는 추천이 2% 발생하는 것은 허용되지만, 결제 흐름에서 잘못된 결정을 내리는 것은 0.1%도 허용되지 않을 수 있다. 이 차이를 명확히 하려면 task를 영향도 기준으로 분류하고, 각 분류마다 별도의 예산을 부여해야 한다. This is a risk-weighted budget, not a flat average. 운영자는 예산 소진의 속도를 관측하면서 기능 확장, 모델 교체, 데이터 파이프라인 업데이트의 타이밍을 결정한다. 예산이 부족한 상태에서 기능을 밀어붙이는 것은 “이후에 고치자”라는 말로 위험을 빚는 것과 같다. 신뢰성 예산이 존재하면 그 빚이 언제 얼마나 쌓이는지 보이기 때문에, 운영은 더 이상 감이 아닌 계산이 된다.

Reliability Budget을 도입하면 팀 문화도 바뀐다. 기존에는 실패가 발생하면 “왜 실패했는가”에만 집중했지만, 이제는 “이 실패가 예산 내에서 발생한 것인지”를 먼저 판단하게 된다. 예산 내 실패는 학습 비용이고, 예산 초과 실패는 구조적 리스크다. This distinction changes postmortem priorities. 예산 내 실패는 원인 분석과 개선 루프를 통해 학습으로 전환할 수 있지만, 예산 초과 실패는 시스템 설계 자체를 재검토해야 한다. 특히 에이전트가 여러 도구와 정책을 결합하는 구조에서는 실패의 원인이 단일 요소가 아니라 상호작용에서 발생한다. 그러므로 예산은 단순한 신뢰성 지표가 아니라, 설계와 운영의 기준을 통합하는 언어가 된다. In short, budget makes trust measurable and operational.

2. Failure Containment 전략: 실패를 격리하고 영향 반경을 통제하는 구조

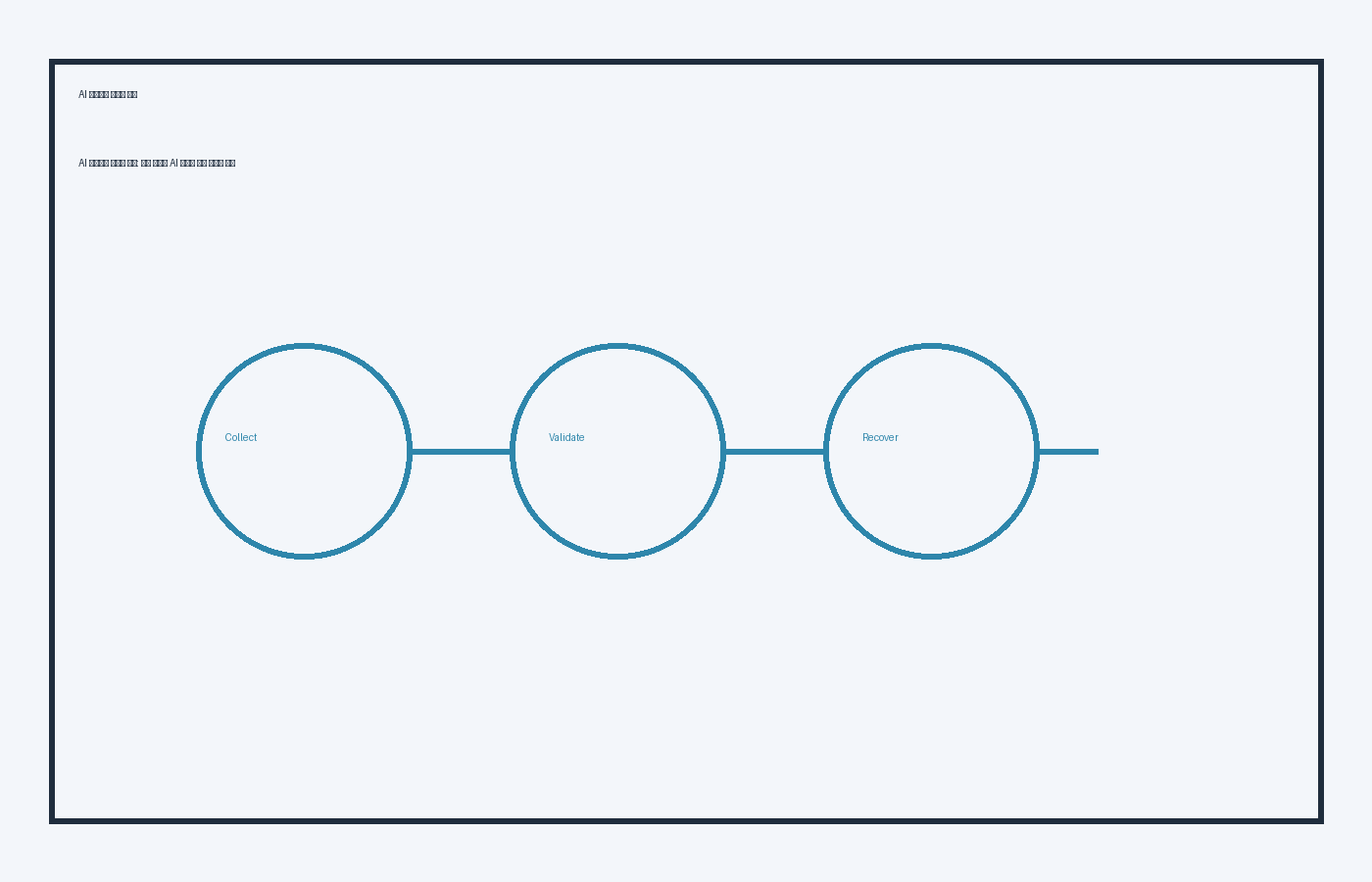

Failure Containment는 “실패를 완전히 막는다”가 아니라 “실패가 어디까지 퍼질 수 있는지 통제한다”는 사고방식이다. 에이전트 시스템은 복수의 도구, 외부 API, 내부 데이터 소스를 연결하므로 단일 장애가 연쇄적으로 전파될 수 있다. 이때 필요한 것은 격리 구조다. 예를 들어 high-risk task는 반드시 sandbox 환경에서 시뮬레이션을 거친 후 실제 실행으로 넘어가게 하고, 실패 시에는 즉시 human review로 전환하는 정책을 둔다. This is a containment circuit, not a warning. 에이전트가 실패했을 때, 실패의 결과가 다른 사용자 세션이나 다른 기능으로 번지지 않도록 경계를 세우는 것이 핵심이다. 격리는 단지 기술적인 방화벽이 아니라, 운영 정책과 권한 설계의 결합으로 이루어진다.

실패 격리를 설계할 때 중요한 것은 “실패 경로의 다양성”을 인식하는 것이다. 어떤 실패는 모델의 hallucination에서 시작되고, 어떤 실패는 툴 호출 지연에서 시작되며, 어떤 실패는 정책 업데이트의 비동기 적용에서 발생한다. 따라서 단일한 보호 장치로는 부족하다. multi-layer containment가 필요하다. 첫 번째 층은 입력 검증이다. 입력이 불완전하거나 민감도가 높은 경우 즉시 경고를 발생시키고, 처리 경로를 제한한다. 두 번째 층은 실행 단계의 rate limit과 resource guardrail이다. 실행 중 과도한 비용이 발생하거나 지연이 길어지면 자동으로 abort한다. 세 번째 층은 결과 검증이다. output validation rules를 통해 결과가 정책 범위를 벗어났는지 확인한다. Each layer reduces blast radius by design. 이렇게 계층을 나누면 실패가 발생하더라도 한 단계에서 멈추거나 영향 범위가 축소된다.

Failure Containment의 운영적 가치는 “복구 속도”에 있다. 격리가 잘 설계된 시스템은 실패가 발생했을 때 완전한 셧다운 대신 부분적인 제한만 적용할 수 있다. 즉, 시스템 전체가 멈추는 것이 아니라 일부 기능만 제한된 모드로 전환된다. This is graceful degradation. 예를 들어 추천 기능이 불안정할 때는 추천을 중단하고 기본 정렬만 제공하는 모드로 전환할 수 있다. 고객은 서비스가 완전히 멈춘다고 느끼지 않고, 운영팀은 안정적으로 원인을 분석할 시간을 확보한다. Failure containment은 결국 “전면 중단 vs 부분 제한”의 선택지를 만들고, 그 선택지가 시스템의 신뢰를 지키는 핵심 장치가 된다.

3. 관측 가능성과 품질 신호의 연결: SLO, 운영 지표, 사용자 체감의 매핑

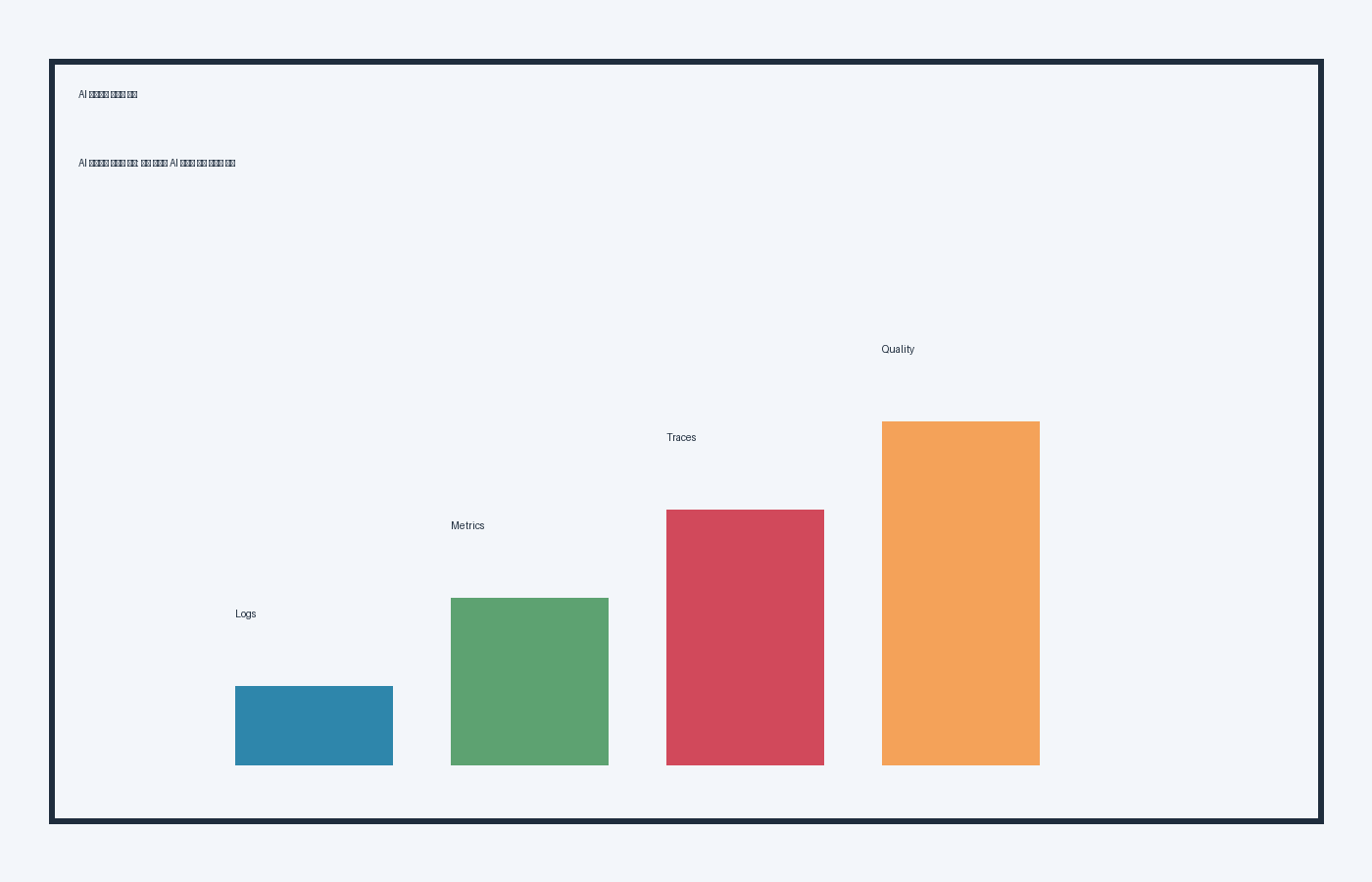

관측 가능성은 단순히 로그를 남기는 행위가 아니라, 신뢰성 예산과 실패 격리를 작동시키는 센서다. 많은 조직이 대시보드를 운영하지만, 그 대시보드는 실제 의사결정과 연결되지 않는 경우가 많다. The missing link is mapping. SLO(서비스 수준 목표), 운영 지표, 사용자 체감 지표를 한 개의 체계로 묶어야 한다. 예를 들어 “응답 지연 P95 2초 이하”라는 SLO는 내부에서는 latency metric으로 보이지만, 사용자는 “서비스가 느리다”는 체감으로 경험한다. 이 둘의 연결이 없으면 지표는 숫자에 머무르고, 체감은 불만으로 남는다. 따라서 지표 설계의 핵심은 “사용자 체감이 어떤 내부 지표로 환원되는가”를 설계하는 것이다.

관측 지표는 크게 세 종류로 나누는 것이 실무적으로 유용하다. 첫째는 process metrics다. 요청 수, 처리 속도, tool call 성공률 같은 내부 운영 지표다. 둘째는 quality metrics다. 정답률, policy violation rate, 사실 오류 비율 같은 품질 지표다. 셋째는 trust metrics다. 사용자 피드백, 재사용률, 수동 개입 비율 같은 체감 기반 지표다. This triad is essential. process는 시스템이 돌아가는지 보여주고, quality는 시스템이 올바르게 동작하는지 보여주며, trust는 사용자 경험이 유지되는지 보여준다. 이 세 가지가 한 화면에서 연결되어야 한다. 예를 들어 quality 지표가 떨어졌을 때 trust 지표도 동시에 하락한다면, 이는 단순한 오류가 아니라 사용자 신뢰 손상의 신호다. 그 순간이 바로 containment 정책을 발동해야 하는 시점이다.

또한 관측 가능성은 사후 분석뿐 아니라 사전 경고를 위해 설계되어야 한다. “실패가 발생했다”는 로그는 이미 늦은 신호다. 중요한 것은 drift signal이다. 예를 들어 특정 토픽에 대한 응답 품질이 7일 평균 대비 15% 하락했다면, 아직 사용자 불만이 표면화되지 않았더라도 위험 신호로 해석할 수 있다. Early warning beats postmortem. 이를 위해서는 baseline 모델과 변화를 비교할 수 있는 관측 구조가 필요하다. 특히 에이전트 시스템은 도메인별로 품질 편차가 크기 때문에, 전체 평균보다 세그먼트 단위 지표가 중요하다. 관측 가능성은 결국 운영 팀이 “언제 멈추고 언제 진행할 것인가”를 결정하게 만드는 나침반이다.

4. 데이터·모델·정책의 삼각 정렬: drift와 policy misalignment를 줄이는 방법

에이전트 운영에서 가장 위험한 순간은 데이터, 모델, 정책이 서로 다른 속도로 변할 때 발생한다. 데이터는 빠르게 변한다. 모델은 주기적으로 업데이트된다. 정책은 느리게 바뀐다. 이 속도 차이가 누적되면 시스템은 ‘규칙을 모르는 모델’ 혹은 ‘현실을 모르는 정책’이 된다. This misalignment is a silent failure mode. 예를 들어 고객 문의 데이터가 달라졌는데 정책 필터가 그대로라면, 에이전트는 필요한 정보를 차단하거나 엉뚱한 답변을 생산하게 된다. 반대로 정책이 업데이트되었는데 모델이 반영하지 못하면, 규정 위반이 발생할 수 있다. 따라서 삼각 정렬을 유지하기 위한 운영 루프가 필요하다.

삼각 정렬의 첫 단계는 “변화 탐지”다. 데이터 drift는 통계적 지표로 관측할 수 있다. 토픽 분포, 키워드 빈도, 입력 길이 분포의 변화가 대표적이다. 모델 drift는 성능 지표로 관측한다. 예를 들어 동일한 validation set에서의 품질 점수가 일정 범위를 벗어나면 drift로 판단한다. 정책 drift는 문서 변경 로그와 실제 적용 여부를 비교하는 방식으로 관리한다. The key is synchronization. 변화 탐지 이후에는 정책-모델-데이터의 갭을 줄이는 작업이 자동화되어야 한다. 예를 들어 정책 변경이 발생하면 모델 프롬프트나 룰베이스가 자동으로 업데이트되고, 그 결과가 샘플 테스트를 거치도록 한다. 이 과정이 수동이면 속도 차이는 다시 벌어진다.

삼각 정렬은 결국 운영 조직의 협업 구조에 달려 있다. 데이터 팀은 drift를 빠르게 감지하고, 모델 팀은 그 drift에 맞는 업데이트를 준비하며, 정책 팀은 변경의 영향 범위를 문서화해야 한다. 이 세 팀이 분리되어 있으면 정렬은 느려지고 위험은 커진다. Therefore you need a shared change protocol. 예를 들어 “정책 변경 시 반드시 모델 QA 승인 필요” 같은 규칙을 두거나, “데이터 drift 발생 시 48시간 내 정책 영향 평가” 같은 SLA를 정의해야 한다. 삼각 정렬이 유지되면 에이전트는 안정적으로 진화하지만, 정렬이 깨지면 시스템은 빠르게 불안정해진다. 이 차이는 사용자 체감에서 즉시 드러난다.

5. 실행 운영 프레임: 팀 구조, 의사결정, 개선 루프를 실무화하기

신뢰성 설계가 성공하려면 기술만으로는 부족하다. 운영 조직이 의사결정 구조를 갖추고, 그 구조를 지속적으로 실행해야 한다. 실무에서는 “누가 결정하는가”와 “언제 멈추는가”가 불명확할수록 실패가 커진다. A decision protocol reduces ambiguity. 예를 들어 Reliability Budget이 70% 소진되면 신규 기능 출시를 중단하고, 85% 소진 시에는 정책 검토 위원회가 자동으로 소집되도록 한다. 이처럼 숫자와 행동을 연결해야 한다. 또한 Failure Containment의 발동 기준도 자동화되어야 한다. 수동으로 판단하면 늦고, 감정이 개입되면 기준이 흔들린다. 따라서 운영 프레임은 기술적 자동화와 조직적 합의가 동시에 필요하다.

개선 루프는 “사후 분석 → 원인 파악 → 정책/모델/데이터 업데이트 → 재검증”의 순환으로 이루어진다. 중요한 것은 이 루프가 지표와 연결되어야 한다는 것이다. 예를 들어 policy violation rate가 증가하면 정책팀이 업데이트를 준비하고, 그 업데이트가 새로운 모델 프롬프트나 룰로 반영되며, 이후 SLO가 개선되는지 확인해야 한다. This is a closed loop, not a report. 개선 루프가 닫히지 않으면 동일한 오류가 반복되고, 신뢰성 예산이 반복적으로 소진된다. 따라서 운영팀은 루프의 상태를 모니터링하고, 루프가 멈추면 다시 가동시키는 역할을 맡아야 한다. 이 역할은 단순한 운영이 아니라 제품 안정성의 핵심이다.

마지막으로, 신뢰성 운영은 “속도와 신뢰의 균형”을 다루는 문제다. 성장이 중요한 조직일수록 속도에 치우치기 쉽고, 안정성이 중요한 조직일수록 보수적으로 느려질 수 있다. Reliability Budget과 Failure Containment는 이 균형을 수치와 구조로 표현하는 장치다. When trust is quantified, speed can be negotiated. 결국 신뢰성 설계는 기술적 안전장치가 아니라, 조직 전체가 같은 언어로 위험을 다루는 프레임이 된다. 이 프레임이 유지될 때 에이전트 시스템은 빠르게 성장하면서도 무너지지 않는다. 신뢰성은 단순히 에러를 줄이는 활동이 아니라, 성장 가능한 운영 체계를 만드는 전략이다.

Tags: agent-reliability,agent-safety,ai-governance,AI,ai-ops-runbook,agent-monitoring,accuracy-metrics,agent-slo,agent-performance,agent-ops