목차

- 왜 지금 ‘승인 게이트’인가

- 운영 루틴의 기본 구조: Detection → Review → Decision

- 승인 게이트의 4단계 설계

- Human-in-the-loop의 비용과 효과

- 신뢰 지표와 승인 기준의 연결

- 변경 관리(Change Management)와 릴리스 준비도

- 실패를 줄이는 리뷰 프레임워크

- 조직 리듬과 회의 설계

- 데이터 신호 감사(Signal Audit) 루틴

- 사례 시나리오: 고객지원 에이전트 운영

- 자동화와 인간 판단의 균형

- 마무리: 운영을 지속가능하게 만드는 최소 루틴

- 승인 게이트 운영 로그와 학습

- 위험 구간별 샘플링 전략

- 최소 실행 체크포인트

1. 왜 지금 ‘승인 게이트’인가

AI 에이전트가 현업에 깊이 들어오면서, “빠르게 배포한다”는 말이 곧 “빠르게 위험을 확산시킨다”로 바뀌는 순간이 많아졌습니다. 모델 성능이 일정 수준을 넘으면 자동화가 가능해 보이지만, 운영 현장에서는 예측하지 못한 변수가 늘 존재합니다. 그래서 승인 게이트는 느림의 상징이 아니라, 빠른 운영을 가능하게 하는 안전 밸브입니다.

In mature operations, approval gates are not about bureaucracy. They are about speed with guardrails. A well-designed gate prevents the wrong change from reaching production, which is the fastest way to protect trust.

승인 게이트는 “누가 승인할 것인가”의 문제가 아니라 “어떤 조건에서 승인할 것인가”의 문제입니다. 조건이 명확하면 승인 속도는 오히려 빨라집니다. 즉, 승인 게이트는 인간의 감으로 운영되는 장치를, 측정 가능한 기준으로 바꾸는 일입니다.

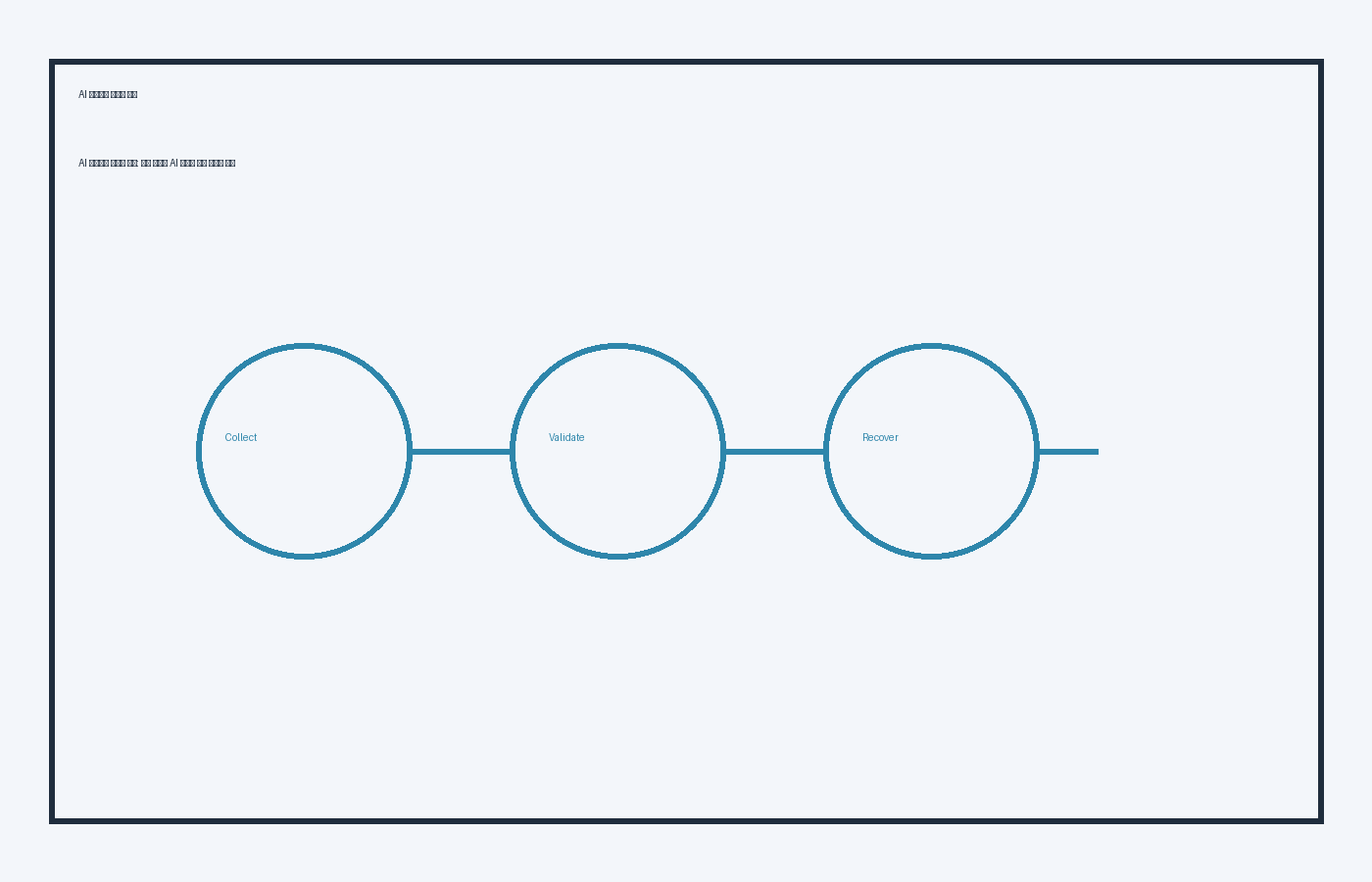

2. 운영 루틴의 기본 구조: Detection → Review → Decision

운영 루틴은 크게 세 단계로 나눌 수 있습니다. 첫째, 이상을 감지하는 Detection. 둘째, 맥락을 확인하고 원인을 좁히는 Review. 셋째, 실제 조치를 결정하는 Decision입니다. 이 구조를 명확히 하면 ‘누가 언제 무엇을 해야 하는지’가 분명해집니다.

Think of it as a control loop. Detection is the sensor, Review is the filter, and Decision is the actuator. If any layer is weak, the loop becomes noisy or slow.

많은 조직이 Detection은 잘하지만 Review 단계가 느슨합니다. 알림은 많지만, 어떤 알림이 실제 조치로 이어져야 하는지 분리되지 않습니다. 그래서 승인 게이트는 Review 단계의 품질을 높이는 도구로 작동합니다. Review가 잘 되면 Decision은 빨라지고, 결과적으로 운영 리듬이 안정됩니다.

3. 승인 게이트의 4단계 설계

승인 게이트는 단일 단계가 아니라 최소 4단계로 설계하는 것이 좋습니다. 1) 사전 조건 확인, 2) 위험 분류, 3) 실행 기준 체크, 4) 롤백 조건 정의. 이 네 가지가 있어야 승인 자체가 의미를 가집니다.

First, pre-conditions. Are the inputs stable? Is the data pipeline healthy? Second, risk tiering. Is this change low-risk or high-risk? Third, release readiness. Are metrics within agreed thresholds? Fourth, rollback triggers. What will force a stop?

예를 들어 “고객 상담 에이전트의 응답 템플릿 변경”은 겉으로는 작아 보이지만, 감정적 민감도가 높은 상황에서는 리스크가 커질 수 있습니다. 이럴 때 위험 분류가 없다면 작은 변경이 큰 사고로 이어집니다. 승인 게이트는 작은 변경을 ‘작게’ 유지하는 장치입니다.

게이트 설계는 또한 팀 간의 책임 경계를 분명하게 합니다. 운영팀은 “언제 개입해야 하는지”를, 제품팀은 “어떤 조건을 충족해야 하는지”를 알고 움직입니다. 경계가 선명해질수록 협업은 더 빨라집니다.

Clear ownership reduces handoffs. When everyone knows their decision boundary, the gate becomes a flow, not a wall.

이 작은 정렬만으로도 승인 지연의 상당 부분이 사라집니다. 결과적으로 릴리스 속도와 신뢰가 함께 올라갑니다. 팀의 스트레스도 줄어듭니다. 결과가 더 예측 가능합니다.

4. Human-in-the-loop의 비용과 효과

사람이 개입하는 순간 비용이 발생합니다. 하지만 그 비용은 단순히 시간을 의미하지 않습니다. 신뢰를 지키는 비용이며, 문제를 사전에 차단하는 보험료입니다. 다만 이 비용이 무한정 커지지 않도록 설계해야 합니다.

Human-in-the-loop should be selective. You don’t need a person for every minor change. You need a person when the risk profile crosses a threshold. That threshold must be explicit.

따라서 승인 게이트는 ‘사람을 늘리는’ 방향이 아니라 ‘사람의 개입 지점을 좁히는’ 방향이어야 합니다. 예를 들어 사용자 불만이 3% 이상 증가한 경우, 혹은 특정 세그먼트에서 에러율이 급등한 경우에만 인간 승인으로 전환하는 방식입니다.

5. 신뢰 지표와 승인 기준의 연결

승인 기준이 숫자와 연결되지 않으면, 결국 감정과 정치가 개입합니다. 그래서 신뢰 지표(Trust Metrics)를 승인 기준과 연결해야 합니다. 예: 고객 불만율, 리텐션 하락폭, SLA 위반 횟수, 모델 오류율 등입니다.

Approval should be triggered by measurable signals. If trust is not measurable, it cannot be governed. Metrics are the language of operational trust.

예를 들어 SLA 위반이 2회 이상 발생하면 승인 게이트를 강화하고, 운영 리듬을 ‘일간 리뷰’로 전환하는 식입니다. 이렇게 되면 승인 게이트는 감정이 아니라 시스템의 반응으로 작동하게 됩니다.

6. 변경 관리(Change Management)와 릴리스 준비도

운영에서 가장 큰 리스크는 ‘변경’입니다. 따라서 승인 게이트는 변경 관리의 핵심입니다. 변경 자체를 막는 것이 아니라, 변경이 안전하게 적용되는지 확인하는 역할을 합니다.

Release readiness is not just “tests pass.” It includes data drift checks, guardrail metrics, and a rollback plan. If any of these are missing, you are deploying a guess, not a change.

변경 관리 루틴은 문서화와 연결되어야 합니다. 변경 기록이 없으면 사고가 반복되고, 원인을 추적할 수 없습니다. 승인 게이트는 변경 기록을 자동으로 남기게 하여, 운영의 기억을 만듭니다.

추가로, 변경 전후의 성능 스냅샷을 남겨야 합니다. 어떤 지표가 개선되었고 어떤 지표가 악화되었는지 정리하면, 팀은 변경의 trade-off를 명확히 이해할 수 있습니다. 이 스냅샷은 다음 변경의 기준선이 되며, “왜 이 기준을 유지해야 하는가”를 설명하는 근거가 됩니다.

Change management is an evidence trail. If you cannot show before/after deltas, you are not managing change—you are just hoping. The approval gate should enforce this evidence discipline.

7. 실패를 줄이는 리뷰 프레임워크

승인 게이트의 핵심은 ‘리뷰 품질’입니다. 리뷰 품질을 높이기 위해서는 프레임워크가 필요합니다. 예: 의도(Intent), 영향(Impact), 범위(Scope), 대안(Alternatives), 실패 모드(Failure Modes) 등입니다.

A simple review framework prevents tunnel vision. It forces the reviewer to ask: what could go wrong, who is impacted, and how fast can we recover?

이 프레임워크는 복잡할 필요가 없습니다. 5개의 질문이면 충분합니다. (1) 왜 이 변경을 하는가? (2) 누가 영향을 받는가? (3) 실패 시 어떤 손실이 발생하는가? (4) 롤백은 가능한가? (5) 어떤 지표로 성공을 판단할 것인가?

여기에 “최악의 경우” 질문을 하나 더 추가하면 품질이 올라갑니다. 최악의 경우는 무엇이고, 그 상황을 얼마나 빨리 감지하고 복구할 수 있는가? 이 질문은 리뷰를 현실로 끌어옵니다. 이상적인 시나리오만 생각하면 승인 게이트는 무력해집니다.

The worst-case question prevents blind optimism. It forces teams to plan for the bad day, not just the launch day. That is the difference between a review and a pitch.

8. 조직 리듬과 회의 설계

승인 게이트가 효과적이려면 조직 리듬과 연결되어야 합니다. 주간 리뷰, 월간 품질 회의, 분기별 정책 업데이트 같은 리듬이 승인 기준을 강화합니다.

Rituals matter. A weekly review turns ad-hoc approvals into a predictable routine. Predictability lowers cognitive load and speeds up decisions.

리듬이 없으면 승인 게이트는 단발성 이벤트로 끝납니다. 하지만 리듬이 있으면 승인 기준이 조직 문화로 자리 잡습니다. 승인 게이트는 회의와 리포트의 형태로 반복되어야 합니다.

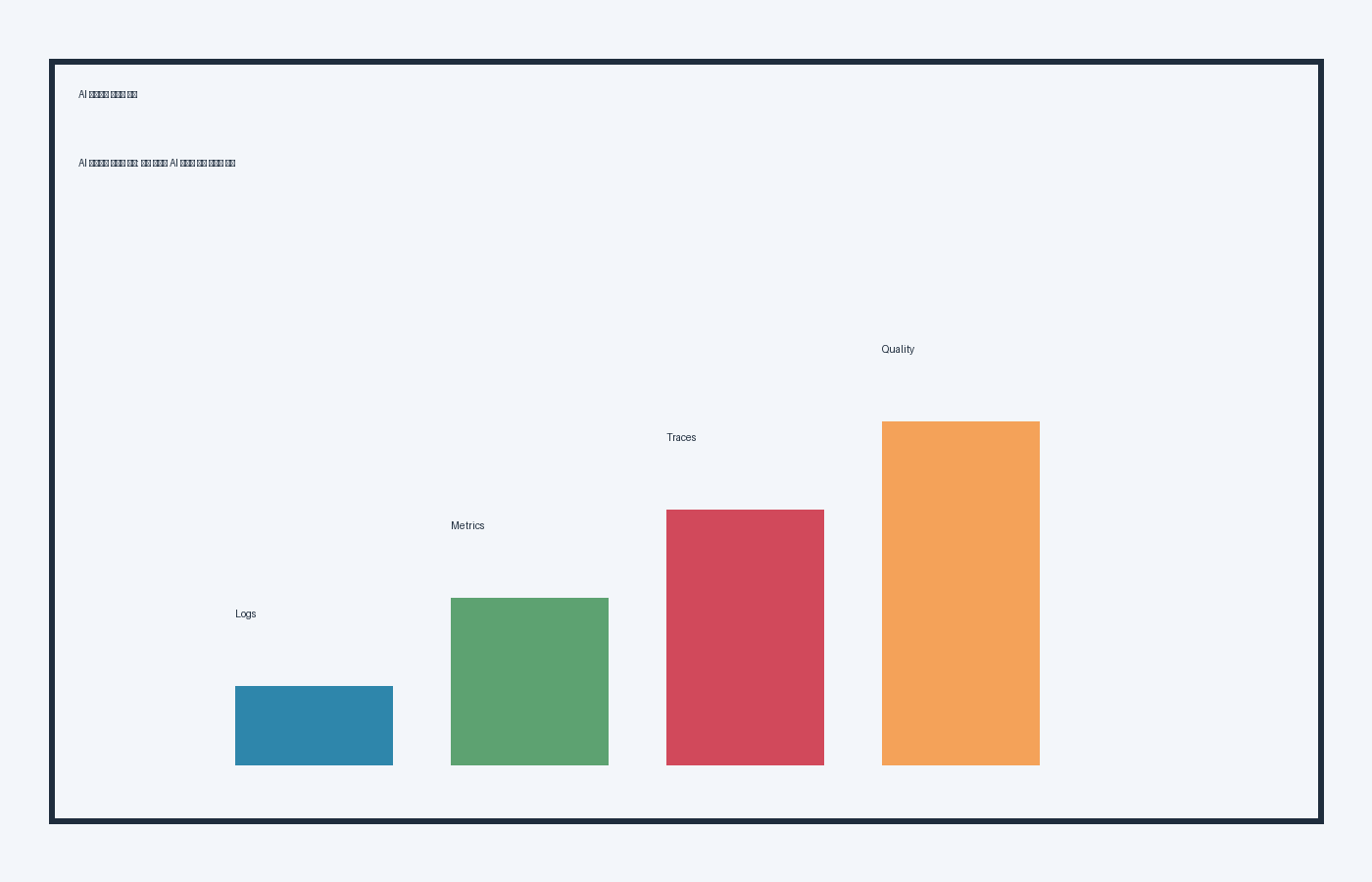

9. 데이터 신호 감사(Signal Audit) 루틴

승인 게이트는 데이터 신호의 신뢰성에 의존합니다. 따라서 신호 자체를 점검하는 “Signal Audit”이 필요합니다. 신호가 잘못되면 승인 기준도 무력해집니다.

Signal audit is like calibrating your instruments. If the sensors are wrong, the decisions are wrong. This is why auditing metrics is a first-class operational task.

예를 들어 모델 오류율이 낮게 표시되는데 고객 불만은 늘어난다면, 신호의 정의가 잘못되었을 가능성이 높습니다. 이런 불일치가 발생할 때 신호를 재정의하는 루틴이 필요합니다.

신호 감사는 월간 또는 분기 단위로 진행해도 충분합니다. 중요한 것은 “지표가 실제 문제를 설명하는가”를 점검하는 것입니다. 이 과정에서 지표의 정의가 바뀌면 승인 기준도 함께 업데이트되어야 합니다. 그래야 승인 게이트가 현실과 동기화됩니다.

Signal audits are about alignment. They ensure that the metrics you approve on are still correlated with user outcomes. Without this alignment, approval gates turn into ritual, not governance.

10. 사례 시나리오: 고객지원 에이전트 운영

고객지원 에이전트를 운영하는 조직을 예로 들겠습니다. 상담 응답 속도는 개선되었지만, 고객 만족도가 하락했습니다. 승인 게이트는 이 상황에서 “속도만으로 배포를 승인하지 않는다”는 기준을 강제합니다.

In this scenario, speed is a vanity metric. The approval gate should require sentiment stability, escalation rate limits, and a clear rollback path before changes go live.

구체적으로는 다음과 같은 승인 조건을 설계합니다. 1) 감정 분석 점수 하락폭 5% 이내, 2) 에스컬레이션 비율 2% 이하, 3) 대응 지연 시간 95퍼센타일 기준 유지. 이 기준이 충족되지 않으면 승인 게이트가 자동으로 작동합니다.

11. 자동화와 인간 판단의 균형

자동화는 운영 속도를 높이지만, 인간 판단은 운영 신뢰를 지킵니다. 승인 게이트는 이 둘의 균형점을 찾아야 합니다. 자동화는 반복 가능한 규칙에, 인간 판단은 예외 상황에 집중해야 합니다.

Automation should handle the 80% repeatable cases, while humans focus on the 20% high-impact or ambiguous cases. This balance keeps operations fast and safe.

즉, 승인 게이트는 “자동 승인 → 조건부 인간 승인 → 필수 인간 승인”으로 단계화하는 것이 좋습니다. 조건이 명확할수록 자동 승인 비율은 늘어나고, 인간 판단은 더 중요한 곳에 집중됩니다.

여기서 핵심은 에스컬레이션 기준의 투명성입니다. 에스컬레이션이 불투명하면 팀은 승인 기준을 신뢰하지 않고, 우회하거나 무시하게 됩니다. 반대로 기준이 명확하면 팀은 더 빠르게 움직이면서도 안전을 확보합니다.

Escalation transparency builds adoption. People follow gates they trust. People bypass gates they don’t understand. Make the trigger logic visible and simple.

12. 마무리: 운영을 지속가능하게 만드는 최소 루틴

승인 게이트는 느린 조직의 상징이 아닙니다. 오히려 빠른 조직이 신뢰를 잃지 않기 위한 최소한의 루틴입니다. 중요한 것은 ‘기준을 명확히 하고, 그 기준을 반복하는 것’입니다.

Operational excellence is boring by design. If your approval gates are predictable, your risk is controllable. That is how speed becomes sustainable.

오늘부터 작은 승인 기준 하나만 정의해도 됩니다. 예를 들어 “고객 불만율 3% 이상 상승 시 승인 강화” 같은 규칙입니다. 이 작은 규칙이 반복되면, 승인 게이트는 조직의 습관이 되고 운영은 안정됩니다.

13. 승인 게이트 운영 로그와 학습

승인 게이트는 실행되는 순간 로그를 남겨야 합니다. 승인된 이유, 거절된 이유, 수정 요청 사항이 기록되지 않으면, 운영은 같은 실수를 반복합니다. 로그는 단순 기록이 아니라, 다음 의사결정을 더 빠르고 정교하게 만드는 데이터입니다.

Approval logs are your operational memory. Without them, every review feels like a first-time debate. With them, you can measure turnaround time, rejection rates, and common failure patterns.

운영 로그는 다음 세 가지 질문에 답해야 합니다. (1) 무엇이 승인 또는 거절을 만들었는가? (2) 그 결정이 실제 결과에 어떤 영향을 주었는가? (3) 다음에는 어떤 기준을 강화하거나 완화해야 하는가? 이 질문을 일관되게 남기면 승인 기준이 자연스럽게 진화합니다.

로그는 정성·정량을 함께 담아야 합니다. 예를 들어 “지표는 안정이었지만 특정 고객군에서 불만 증가 조짐이 보여 보류” 같은 메모가 있어야, 숫자만으로는 보이지 않는 판단 근거가 남습니다. 이 축적이 시간이 지나면 최고의 운영 가이드가 됩니다.

Good logs capture nuance. Numbers tell you what happened; notes tell you why you decided. That nuance is what future operators need to avoid repeating the same hesitation.

14. 위험 구간별 샘플링 전략

모든 변경을 동일한 기준으로 리뷰하면 비용이 폭발합니다. 그래서 위험 구간별 샘플링 전략이 필요합니다. 낮은 위험 구간에서는 10% 샘플 리뷰, 중간 위험에서는 30% 샘플, 높은 위험에서는 100% 리뷰 같은 정책을 적용할 수 있습니다.

Sampling is the bridge between speed and safety. It allows you to keep human oversight without paralyzing the release pipeline. The key is to align sampling rates with risk tiers.

특히 신규 기능이나 고객 신뢰에 직접 영향을 주는 변경은 반드시 전수 검토가 필요합니다. 반대로 문구 수정이나 UI 경미 변경은 샘플만으로도 충분합니다. 샘플링 비율을 리스크에 맞춰 조정하면 승인 게이트는 효율적으로 작동합니다.

15. 최소 실행 체크포인트

승인 게이트를 설계할 때 복잡한 제도를 도입하기 전에, 최소 실행 체크포인트를 먼저 정의하는 것이 중요합니다. 예: 데이터 파이프라인 정상, 주요 KPI 안정, 롤백 시나리오 준비, 담당자 지정. 이 네 가지는 가장 기본적인 안전 장치입니다.

Minimum checkpoints keep the system honest. If you cannot satisfy these basics, you should not ship. This is the simplest and most effective policy a team can enforce.

이 체크포인트는 도입 비용이 낮고 효과가 큽니다. 운영팀은 이 기준을 통해 “지금 배포해도 되는가”를 빠르게 판단할 수 있고, 승인 게이트는 불필요한 논쟁을 줄입니다. 작은 체크포인트가 결국 큰 신뢰를 만듭니다.

또한 체크포인트는 ‘거절의 이유’를 명확히 만듭니다. 거절이 명확하면 불필요한 감정 소모가 줄어듭니다. 이는 운영팀과 제품팀의 관계를 건강하게 유지하는 데 큰 역할을 합니다.

Clear checkpoints depersonalize rejection. The system says no, not the person. This keeps collaboration intact even when decisions are tough.

Tags: 운영루틴,review-gate,human-in-the-loop,change-management,risk-approval,release-readiness,ops-rhythm,postmortem,signal-audit,quality-bar