AI 에이전트와 데이터 파이프라인의 접점은 이제 단순한 연결이 아니라 운영 그 자체다. 모델이 똑똑해져도 데이터가 늦게 도착하거나 스키마가 흔들리면 에이전트는 맥락을 잃는다. 이 글은 파이프라인을 ‘계약 기반 contract-first’로 재구성하고, lineage와 관측 신호를 설계해 드리프트를 조기에 잠그는 방법을 정리한다. I will mix Korean and English because the production team usually reads both; the key is to make the guidance actionable, not theoretical. 결국 목표는 모델의 성능보다 운영의 안정성을 먼저 확보하고, 그 위에 성능과 비용을 얹는 구조를 만드는 것이다.

목차

1. Contract-first 파이프라인과 에이전트의 합의 구조

2. Lineage, observability, and drift control

3. Latency budget과 비용 최적화의 동시 설계

4. 운영 루프: 실험, 롤백, and continuous learning

5. 조직 운영 모델: 역할, 책임, and governance

1. Contract-first 파이프라인과 에이전트의 합의 구조

에이전트가 데이터 파이프라인과 안전하게 상호작용하려면, 데이터 계약이 코드보다 먼저 정의되어야 한다. 여기서 계약은 스키마만을 의미하지 않는다. 어떤 이벤트가 언제 생성되고, 어떤 지연 허용 구간이 있으며, 어떤 품질 게이트를 통과해야 소비 가능한지까지 포함한다. 예를 들어 주문 이벤트가 3분 이상 지연되면, 에이전트의 추천 정책은 정책 B로 내려가도록 합의할 수 있다. This is not just validation; it is a shared protocol between producers and agents. 계약이 명확하면 에이전트는 입력 품질을 스스로 평가하고, 신뢰할 수 있는 구간만을 사용해 추론을 실행한다. 결과적으로 모델이 잘못된 데이터에 의해 흔들리는 리스크가 줄고, 운영자는 문제의 원인을 빠르게 좁힐 수 있다.

계약 기반 구조에서는 데이터 팀과 에이전트 팀의 합의가 문서가 아니라 자동화된 룰로 구현된다. 예를 들어 스키마 버전이 올라가면, feature store는 자동으로 `compatibility mode`를 적용하고, 에이전트는 해당 버전의 feature를 호출할 때 경고 레벨을 높인다. You can think of it as a pact: producers promise a shape and freshness, consumers promise safe fallbacks. 이 합의가 없다면 에이전트는 입력의 불확실성에 노출되고, 결국 운영팀은 어떤 문제든 “모델이 이상하다”는 흐릿한 결론에 머무르게 된다. 계약을 중심에 두면 문제가 데이터인지 모델인지 즉시 판단할 수 있는 분기점이 생긴다.

또 하나의 핵심은 계약을 ‘이벤트 중심’으로 정의하는 것이다. 테이블 중심의 계약은 변화에 느리지만, 이벤트 중심 계약은 변경이 일어나도 변화의 경계를 명확히 한다. 예를 들어 `OrderCreated`, `PaymentConfirmed` 같은 이벤트는 비즈니스 의미를 가진다. When the schema changes, the semantic event still stands; you can version the payload and keep the intent stable. 에이전트는 이벤트 의미를 기반으로 정책을 바꾸기 때문에, 스키마 변경이 정책의 불필요한 변동으로 이어지지 않는다. 결국 이벤트-계약-정책이 하나의 흐름으로 연결되며, 데이터 파이프라인이 단순한 ETL이 아니라 정책 실행의 기반으로 진화한다.

계약의 운영을 위해서는 품질 게이트를 단일 지표가 아니라 다층 구조로 설계해야 한다. 예를 들어 completeness, freshness, and semantic consistency를 각각 별도의 기준으로 두고, 특정 기준이 무너지면 해당 feature 그룹만 제한하는 방식이다. This layered gating approach reduces blast radius and prevents full pipeline shutdown. 다층 게이트는 장애를 작은 단위로 분리해 파이프라인 전체가 멈추는 것을 막는다. 또한 에이전트는 어떤 게이트가 열려 있는지에 따라 정책을 동적으로 바꿀 수 있어, 운영의 유연성이 올라간다.

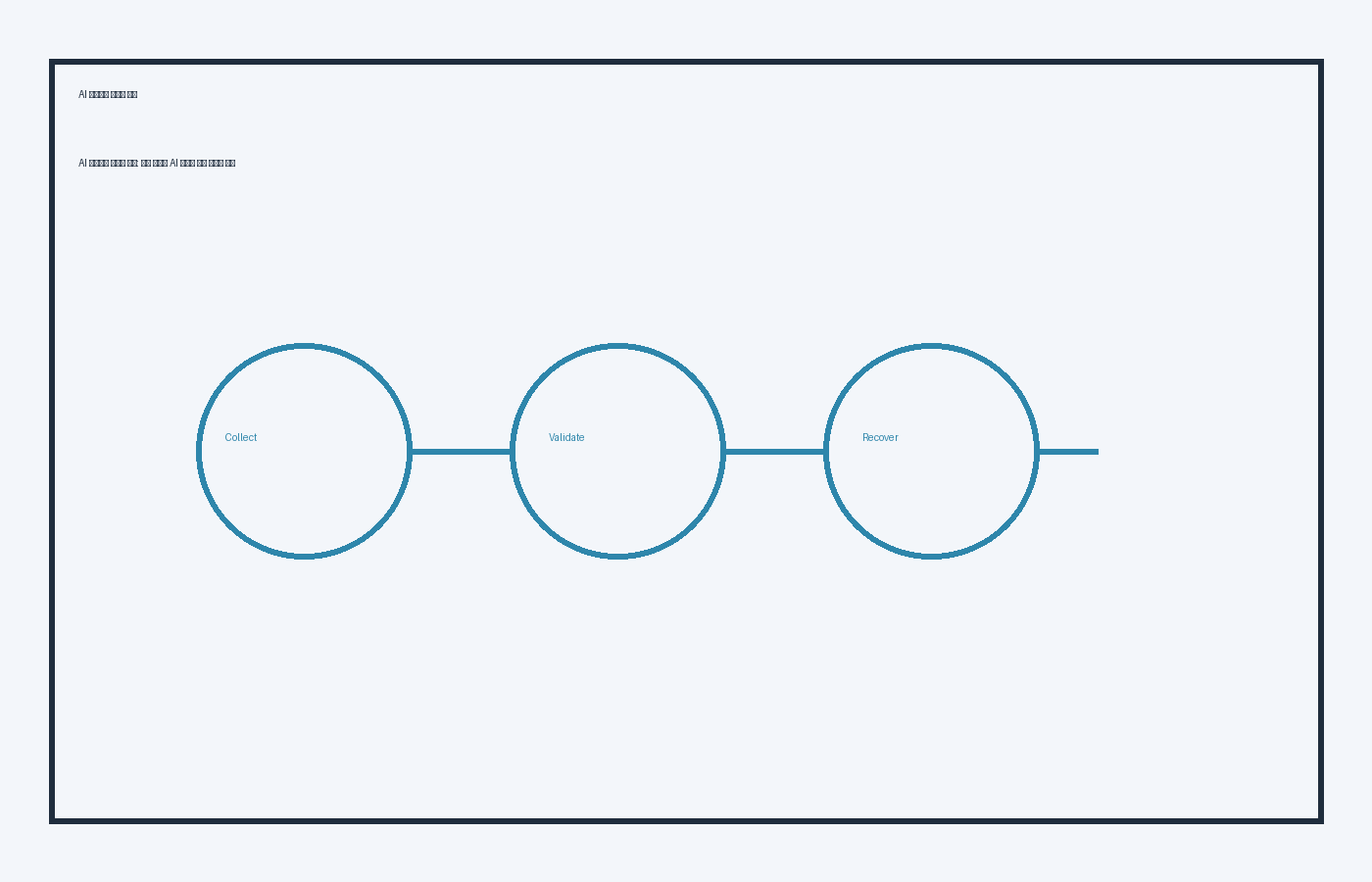

게이트 설계의 또 다른 포인트는 “회복성”이다. 단순히 차단하는 것에 그치지 않고, 어떤 조건에서 게이트가 다시 열리는지 명확히 해야 한다. A recovery-first gate uses sliding windows and gradual ramp-up, not an on/off switch. 이런 회복 로직이 있으면, 파이프라인이 정상화될 때 에이전트는 급격한 변화를 겪지 않고 자연스럽게 정상 모드로 복귀한다. 결국 게이트는 방어막이면서도 복구를 돕는 통로가 되어야 한다.

2. Lineage, observability, and drift control

Lineage는 “어디에서 왔고 어디로 가는가”의 답을 제공한다. 하지만 에이전트 운영에서는 “왜 지금의 판단이 나왔는가”까지 연결해야 한다. 따라서 lineage는 단순한 소스-타깃 매핑이 아니라, 모델 입력과 출력의 원인-결과 트레이스를 포함해야 한다. A practical approach is to attach a lightweight provenance token to each feature bundle, so you can trace back the upstream events, versions, and quality gates. 이 토큰이 있으면 에이전트의 잘못된 행동이 발생했을 때, 데이터 파이프라인의 어느 구간이 문제였는지 즉시 좁힐 수 있다. 즉, lineage는 디버깅의 속도를 결정하는 운영의 뼈대다.

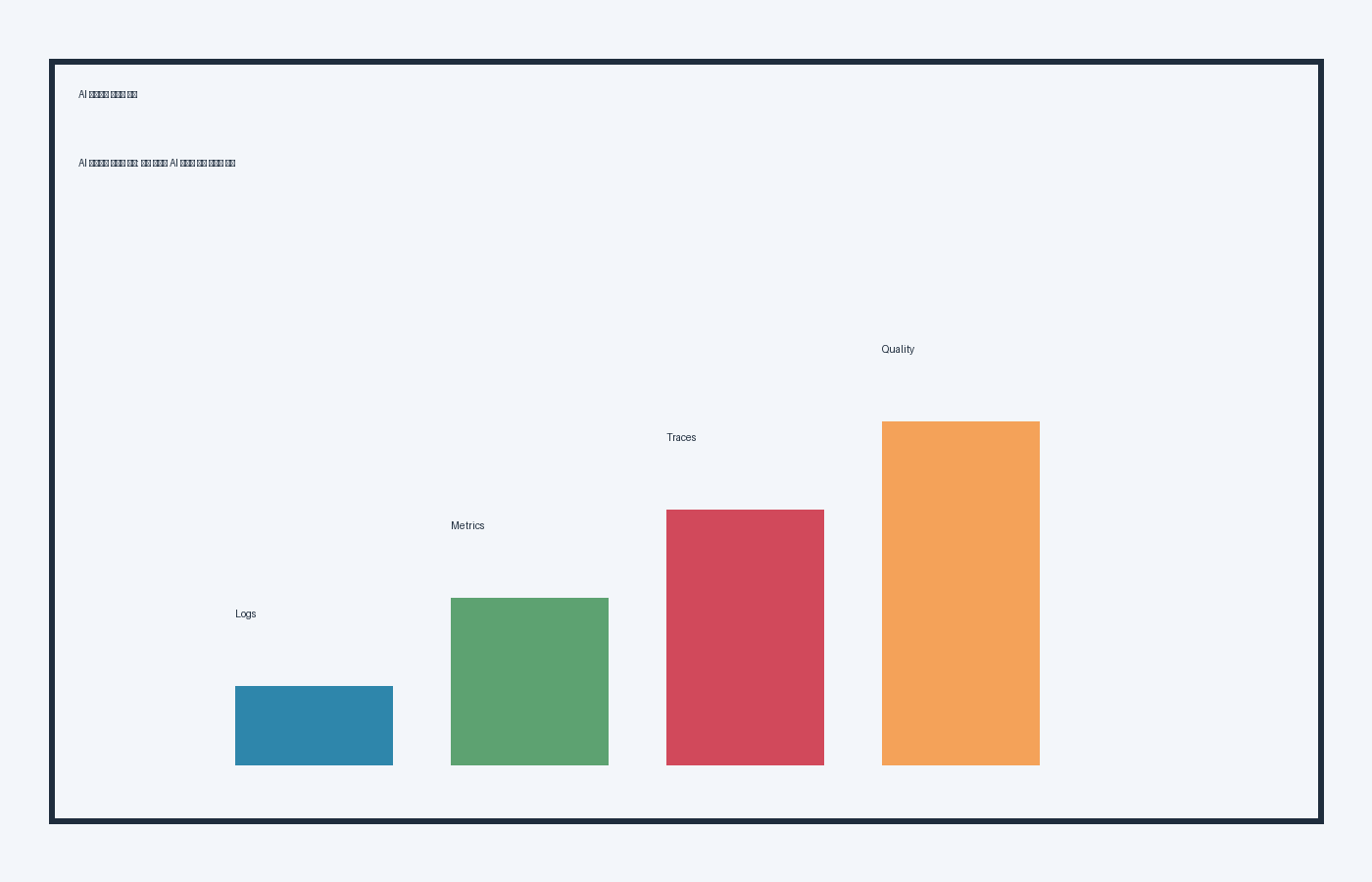

Observability는 신호를 “모니터링”하는 것이 아니라, 운영 의사결정에 쓰이는 기준을 만드는 것이다. 예를 들어 feature freshness, missing rate, schema drift score를 단순히 대시보드에 띄우는 것으로는 부족하다. The agent should read those signals and adjust its policy in real time: fallback models, lower risk thresholds, or reduced autonomy. 이렇게 신호가 의사결정으로 연결될 때, 관측성은 비용이 아니라 자산이 된다. 관측 신호는 사람이 볼 수 있는 로그가 아니라, 에이전트가 읽는 계약의 일부가 되어야 한다.

관측 신호의 품질을 높이려면, 파이프라인의 각 단계에서 “의미 있는 로그”를 남겨야 한다. 단순한 에러 로그가 아니라, 어떤 정책이 어떤 조건으로 트리거 되었는지, 데이터가 어떤 품질 게이트를 통과했는지가 포함되어야 한다. This creates a decision-aware telemetry stream. 이런 텔레메트리가 있어야 운영팀은 신호를 행동으로 연결할 수 있고, 에이전트의 의사결정이 투명해진다.

또한 관측 신호는 단절된 지표가 아니라, 서로 연결된 이야기로 제공되어야 한다. 예를 들어 freshness가 떨어졌다면, 어떤 upstream 이벤트가 늦었는지, 그 이벤트가 어떤 feature에 영향을 주는지를 함께 보여줘야 한다. A narrative observability model reduces cognitive load and speeds up root-cause analysis. 이런 연결형 관측성은 운영팀의 판단 속도를 높이고, 동일한 문제의 재발을 줄인다.

드리프트 제어는 “탐지”보다 “잠금”이 중요하다. 즉, 문제가 발생한 뒤 탐지하는 것이 아니라, 특정 조건을 넘으면 자동으로 흐름을 제한하는 구조다. 예를 들어 스키마 drift score가 임계치를 넘으면, 해당 feature set을 사용하는 에이전트는 자동으로 안전 모드로 전환한다. This is similar to circuit breaker in distributed systems. 데이터가 불안정할 때 에이전트의 행동 범위를 좁혀 피해를 줄이고, 정상화되면 서서히 복귀시키는 방식이다. 이때 복귀 조건 또한 계약에 포함해야 한다. 그렇지 않으면 안전 모드가 장기화되거나, 너무 빠르게 해제되어 반복적인 흔들림이 발생한다.

lineage와 drift가 연결되면, 운영자는 ‘어떤 변화가 어떤 결과를 만들었는지’를 설명할 수 있다. 예를 들어 특정 모델 버전의 클릭률이 하락했을 때, 원인이 모델인지 데이터인지 명확히 분리해야 한다. A lineage-aware system can show that a data source changed, not the model, so the fix belongs to the pipeline team. 이러한 분리가 가능한 조직은 책임의 명확성 때문에 회복이 빠르다. 운영팀이 데이터를 수정할지 모델을 롤백할지에 대한 논쟁이 줄어들고, 실제 조치까지 걸리는 시간이 짧아진다.

3. Latency budget과 비용 최적화의 동시 설계

에이전트는 빠른 응답이 필요하지만, 데이터 파이프라인은 종종 느리다. 여기서 중요한 것은 latency budget을 단순히 “몇 초 안에”로 잡는 것이 아니라, 어떤 결정이 얼마나 최신성을 요구하는지 분류하는 것이다. For instance, pricing updates may tolerate a 10-minute delay, while fraud detection requires near-real-time signals. 이 분류를 먼저 정의하면, 파이프라인의 속도를 모든 곳에 맞추지 않아도 된다. 결과적으로 비용을 줄이면서도 중요한 판단에는 최신 데이터를 유지할 수 있다.

비용 최적화는 캐싱과 배치만으로 해결되지 않는다. 에이전트의 정책 자체를 비용-aware하게 설계해야 한다. 예를 들어 동일한 입력을 반복적으로 받는 경우, 에이전트가 결과를 재사용하도록 설계하거나, 고비용 모델 호출 전 간단한 rule-based filter를 두는 것이 효과적이다. A cost-aware agent uses cheap signals first, then escalates to expensive inference when necessary. 이러한 설계는 파이프라인에도 영향을 준다. 저비용 신호가 우선 제공되도록 파이프라인을 구성하면, 모델 호출량을 줄이면서도 체감 품질은 유지된다.

또한 latency와 비용은 서로 trade-off 관계지만, 운영 시나리오에 따라 균형점이 달라진다. 예를 들어 야간 배치에서 비용을 줄이는 대신, 실시간 경로에서는 latency를 최우선으로 한다. The key is to encode this trade-off into the pipeline, not just in human playbooks. 에이전트가 시간대나 상황에 따라 다른 파이프라인 경로를 선택할 수 있게 하면, 운영자가 매번 정책을 수정하지 않아도 된다. 즉, 파이프라인은 하나의 고정된 경로가 아니라, 상황에 따라 선택되는 다중 경로로 설계되어야 한다.

비용과 latency를 동시에 관리하려면 지표를 통합해야 한다. 단순히 요청당 비용이나 평균 지연시간만 보지 말고, “업무 가치 대비 비용”과 “결정 지연으로 인한 리스크”를 함께 측정해야 한다. A unified metric like value-per-latency can inform whether a new pipeline stage is worth it. 이런 통합 지표가 있으면, 운영팀은 빠른 의사결정을 내릴 수 있고, 에이전트는 정책 선택에 합리적 근거를 갖는다. 결국 효율성은 숫자가 아니라 판단 기준을 만드는 과정에서 나온다.

이 지표를 실제로 쓰기 위해서는 파이프라인에 실험 슬롯을 남겨 두어야 한다. 새로운 feature가 비용을 줄이는지, 아니면 latency를 늘리는지 알아보려면 실험이 필요하다. Experiment-ready pipelines tag traffic with variants and record cost/latency together. 이렇게 실험 데이터를 축적하면, “좋아 보이는 아이디어”와 “실제로 효율을 개선하는 변화”를 구분할 수 있다. 실험 기반 운영은 조직의 직관을 데이터로 보정하는 역할을 한다.

또 하나는 SLA의 다층화다. 하나의 SLA가 모든 요청을 대표하면, 비용과 latency의 균형이 왜곡된다. 그래서 중요도가 높은 요청과 낮은 요청을 분리하고, 각각 다른 SLA와 다른 비용 제한을 둔다. This tiered SLA model lets the agent decide whether to wait for fresh data or proceed with cached signals. 다층 SLA는 운영의 세밀함을 높이고, 에이전트가 맥락에 맞는 결정을 내리도록 돕는다.

4. 운영 루프: 실험, 롤백, and continuous learning

운영 루프는 단순히 “배포-모니터링-수정”이 아니라, 실험과 학습을 반복하는 구조로 설계되어야 한다. 에이전트의 행동은 예측 불가능한 사용자 환경에 노출되므로, 작은 실험이 큰 리스크를 줄인다. For example, shadow traffic can validate a new pipeline version without affecting production outcomes. 이렇게 검증된 결과를 기반으로 점진적으로 전환하면, 데이터 파이프라인 변경이 모델 성능을 망가뜨리는 리스크를 크게 낮출 수 있다.

롤백은 단순한 버튼이 아니다. 데이터 파이프라인에서 롤백은 데이터 손실, 스키마 충돌, 모델 입력 불일치 같은 여러 문제가 동시에 발생할 수 있기 때문이다. 따라서 롤백은 사전에 준비된 “되돌림 경로”가 필요하다. A safe rollback requires compatible schemas, cached fallbacks, and a preserved lineage trail. 이러한 준비가 없으면, 롤백은 문제 해결이 아니라 또 다른 장애를 만들 수 있다. 롤백 경로를 설계하는 과정 자체가 운영 안정성을 강화하는 학습 과정이 된다.

마지막으로, continuous learning은 데이터 파이프라인과 모델이 함께 진화한다는 가정에서 출발한다. 에이전트가 학습할 데이터의 quality score, freshness, and provenance가 명확히 기록되어야 모델이 ‘무엇을 학습했는지’가 보인다. Without this, the model improves in a vacuum and operators cannot explain why performance shifts. 지속적 학습의 핵심은 기술이 아니라 기록과 추적이다. 결국 에이전트와 파이프라인은 함께 학습하는 하나의 시스템이며, 그 시스템의 신뢰는 기록에서 시작된다.

운영 루프의 성숙도는 ‘버전 관리’에서 갈린다. 데이터 파이프라인의 모든 변경은 버전으로 남아야 하고, 해당 버전이 어떤 모델과 결합되었는지 추적되어야 한다. A versioned pipeline lets you answer “Which data pipeline produced this model output?” in seconds. 이 질문에 즉답할 수 있으면 장애 대응 시간은 급격히 줄어든다. 반면 버전 관리가 느슨하면, 운영팀은 문제의 원인을 찾느라 시간을 소모하고 그 사이에 사용자 경험은 악화된다.

5. 조직 운영 모델: 역할, 책임, and governance

기술 설계만큼 중요한 것은 운영 조직의 역할 분담이다. 데이터 팀, 에이전트 팀, 플랫폼 팀이 각각 무엇을 책임지는지 명확해야 한다. For instance, the data team owns data contracts and freshness SLAs, while the agent team owns policy logic and fallback behaviors. 이러한 역할 분리가 있으면 문제 발생 시 책임 소재가 명확해지고, 해결 속도가 빨라진다. 역할이 흐릿하면 모든 문제는 “모델이 이상하다” 혹은 “데이터가 이상하다”로 귀결되어 반복적인 갈등이 생긴다.

거버넌스는 통제만 의미하지 않는다. 안전한 실험과 빠른 학습을 가능하게 만드는 최소한의 규칙을 뜻한다. A lightweight governance model defines what can change without approval, and what requires explicit review. 예를 들어 feature의 의미를 바꾸는 변경은 리뷰 대상이지만, 비즈니스 로직과 무관한 성능 개선은 자동 배포로 허용할 수 있다. 이렇게 규칙을 명확히 하면, 속도와 안전성을 동시에 확보할 수 있다.

마지막으로, 운영 문서화는 단순한 기록을 넘어 지식의 재사용을 가능하게 한다. 에이전트가 어떤 조건에서 어떤 정책을 선택했는지, 파이프라인이 어떤 오류 패턴을 보였는지 정리하면, 다음 장애는 예측 가능한 범주로 들어온다. Documentation turns incidents into reusable knowledge, and reusable knowledge reduces fear. 이런 축적이 있을 때 조직은 새로운 실험을 두려워하지 않고, 운영의 확장성을 확보할 수 있다.

조직 문화 측면에서도 중요한 포인트가 있다. 데이터 계약과 observability는 종종 “통제”로 받아들여지지만, 실제 목적은 빠른 자율성을 보장하는 것이다. When teams know the guardrails, they move faster, not slower. 가드레일이 없는 자율성은 결국 장애와 야근으로 돌아오며, 이것이 반복되면 조직은 다시 통제로 회귀한다. 계약 기반 운영은 자율성과 안전성을 동시에 확보하기 위한 현실적인 해법이다.

또한 에이전트 운영의 성숙은 “입력-출력”만 보는 조직에서 “결정-근거”를 보는 조직으로의 전환을 요구한다. 즉, 어떤 입력이 들어왔는지뿐 아니라 왜 그 입력이 신뢰되었는지를 설명할 수 있어야 한다. A decision log that ties to lineage becomes a compliance asset and a debugging asset at the same time. 이 로그가 있으면 내부 감사나 외부 규제 대응도 쉬워지고, 운영팀은 더 빠르게 개선에 집중할 수 있다.

마지막으로, 성공적인 파이프라인-에이전트 통합은 기술적 완벽함보다 꾸준한 운영 리듬에서 나온다. 주간 리뷰, 월간 실험 회고, 분기별 계약 업데이트 같은 리듬이 조직의 예측 가능성을 높인다. Rhythm beats heroics; steady iteration beats emergency fixes. 이런 운영 리듬이 자리 잡으면, 작은 실험이 큰 학습으로 이어지고, 이는 다시 안정성과 혁신의 선순환을 만든다.

결론적으로, AI 에이전트와 데이터 파이프라인의 통합은 기능 연결이 아니라 운영 설계의 문제다. 계약을 중심에 두고, lineage와 관측 신호를 의사결정에 연결하며, latency와 비용의 균형을 설계해야 한다. The most resilient systems treat data as a living contract, not a static asset. 이러한 접근이 있을 때 에이전트는 안정적으로 성장하고, 조직은 모델의 똑똑함이 아니라 운영의 강함으로 경쟁력을 확보할 수 있다. 그리고 그 강함은 결국 작은 운영 습관에서 시작된다.

Tags: data-pipeline,event-streaming,schema-evolution,feature-store,data-contracts,latency-budget,observability,lineage,orchestration,feedback-loop