AI 에이전트 신뢰성 설계: 실패를 관리하고 회복을 설계하는 운영 아키텍처

TOC

- 문제 정의: 신뢰성은 성능의 합이 아니라 운영의 습관이다

- Reliability Model: failure budget, confidence routing, and scope control

- Guardrail Design: 정책을 코드로, 코드 이전에 원칙으로

- Recovery Path: 재시도, 대체 경로, human-in-the-loop

- Observability Loop: 신뢰를 측정하고 개선으로 연결하기

- Long-run System: 장기 워크플로와 지식 누적

1. 문제 정의: 신뢰성은 성능의 합이 아니라 운영의 습관이다

AI 에이전트를 운영할 때 가장 큰 착각은 “정확도만 올리면 된다”는 믿음이다. 정확도는 필요조건이지만 충분조건이 아니다. 신뢰성은 모델의 단일 성능이 아니라, 운영 전반의 결정을 일관되게 만드는 구조적 습관이다. 즉, reliability는 결과의 평균이 아니라, 실패를 다루는 태도에서 만들어진다. The system is trusted not because it never fails, but because it fails predictably and recovers responsibly.

초기 배포 단계에서는 몇 번의 성공이 큰 착각을 낳는다. 작은 트래픽에서 좋은 결과가 나오면, 확장 구간에서도 동일한 품질이 유지될 거라 믿는다. 하지만 실제 운영에서는 입력 분포가 바뀌고, 요청이 예측 불가능한 방식으로 몰리며, 모델 비용이 급격히 변동한다. 이때 신뢰성은 “에이전트가 잘 맞힌 비율”이 아니라 “실패를 어떤 절차로 봉합하는가”에서 결정된다.

따라서 신뢰성 설계는 기술 스택이 아니라 운영 스택의 설계다. 운영 스택은 정책, 관측, 책임, 그리고 복구 루프의 조합이다. 이 글은 그 조합을 단계별로 풀어 간다. 우리는 에이전트를 하나의 서비스로 다루고, 서비스의 신뢰성을 운영 설계로 만들어야 한다.

2. Reliability Model: failure budget, confidence routing, and scope control

신뢰성 모델의 첫 번째 원칙은 failure budget이다. 실패를 0으로 만들겠다는 목표는 비용과 품질 모두를 망친다. instead, define a budget for acceptable failure and manage it like a financial resource. 실패를 예산화하면, 팀은 위험을 숨기는 대신 관리한다. 이는 단순히 KPI를 바꾸는 것이 아니라, 운영 문화 자체를 바꾸는 결정이다.

두 번째 원칙은 confidence routing이다. 모든 요청을 동일한 모델, 동일한 프롬프트로 처리하는 것은 곧 비용 폭발과 품질 불안정으로 이어진다. 신뢰성은 요청의 난이도를 분류하고, 난이도에 맞는 경로로 분기하는 것에서 시작된다. 예를 들어 저위험 요청은 경량 모델로, 고위험 요청은 고성능 모델 또는 인간 검토 경로로 보낸다. This is not over-engineering; it is risk-aware routing.

세 번째 원칙은 scope control이다. 에이전트가 모든 것을 해결하려는 순간, 실패는 눈덩이처럼 커진다. 서비스 스코프는 명확히 정의되어야 하고, 스코프 밖의 요청은 graceful fallback으로 처리해야 한다. 스코프는 기능의 경계이자 책임의 경계다. 책임이 모호해지면 신뢰성도 모호해진다.

이 세 가지는 서로 연결된다. failure budget이 있어야 routing의 기준이 생기고, routing이 있어야 scope control이 현실에서 작동한다. 결국 신뢰성 모델은 “어떤 실패를 허용하고, 어떤 실패를 회피하며, 어떤 실패를 복구할 것인가”의 결정 구조다.

3. Guardrail Design: 정책을 코드로, 코드 이전에 원칙으로

가드레일은 규칙의 집합이 아니다. 가드레일은 “우리가 실패를 어떤 방향으로만 허용할 것인가”에 대한 약속이다. Guardrails define the shape of failure, not just the absence of it. 즉, 가드레일은 잘못된 답을 막기보다, 잘못된 답이 어떤 형태로만 발생하도록 제한한다.

가드레일 설계의 출발점은 원칙 정의다. 예를 들어 “민감한 금융 조언 금지”라는 원칙은 단순한 금지 문구가 아니라, 시스템 전반에 걸친 정책으로 확장되어야 한다. 프롬프트에 경고를 넣는 것만으로는 충분하지 않다. 요청 분류 단계에서 민감도 점수를 부여하고, 민감도가 높으면 안전한 템플릿을 강제하고, 출력 후에는 정책 검사로 필터링해야 한다. 이 다층 설계가 없으면 가드레일은 종이벽에 불과하다.

또한 가드레일은 정적이지 않다. 규정이 변하고, 서비스 목표가 변하면 가드레일도 업데이트되어야 한다. The guardrail is a living policy, not a frozen rule. 운영팀은 정책 변경 로그를 관측 지표와 연결해야 하고, 변경 전후의 품질 변화를 기록해야 한다. 이렇게 해야 가드레일이 품질 저하를 부르는지, 혹은 위험을 줄이는지 판단할 수 있다.

실무적으로는 다음 구조가 유효하다. 1) 원칙 문서화, 2) 정책 코드화, 3) 프롬프트/도구 레벨 적용, 4) 출력 레벨 검사, 5) 실패 로그 분석. 이 다섯 단계는 독립이 아니라 하나의 파이프라인이다. 파이프라인의 어느 단계가 약하면 전체 가드레일이 약해진다.

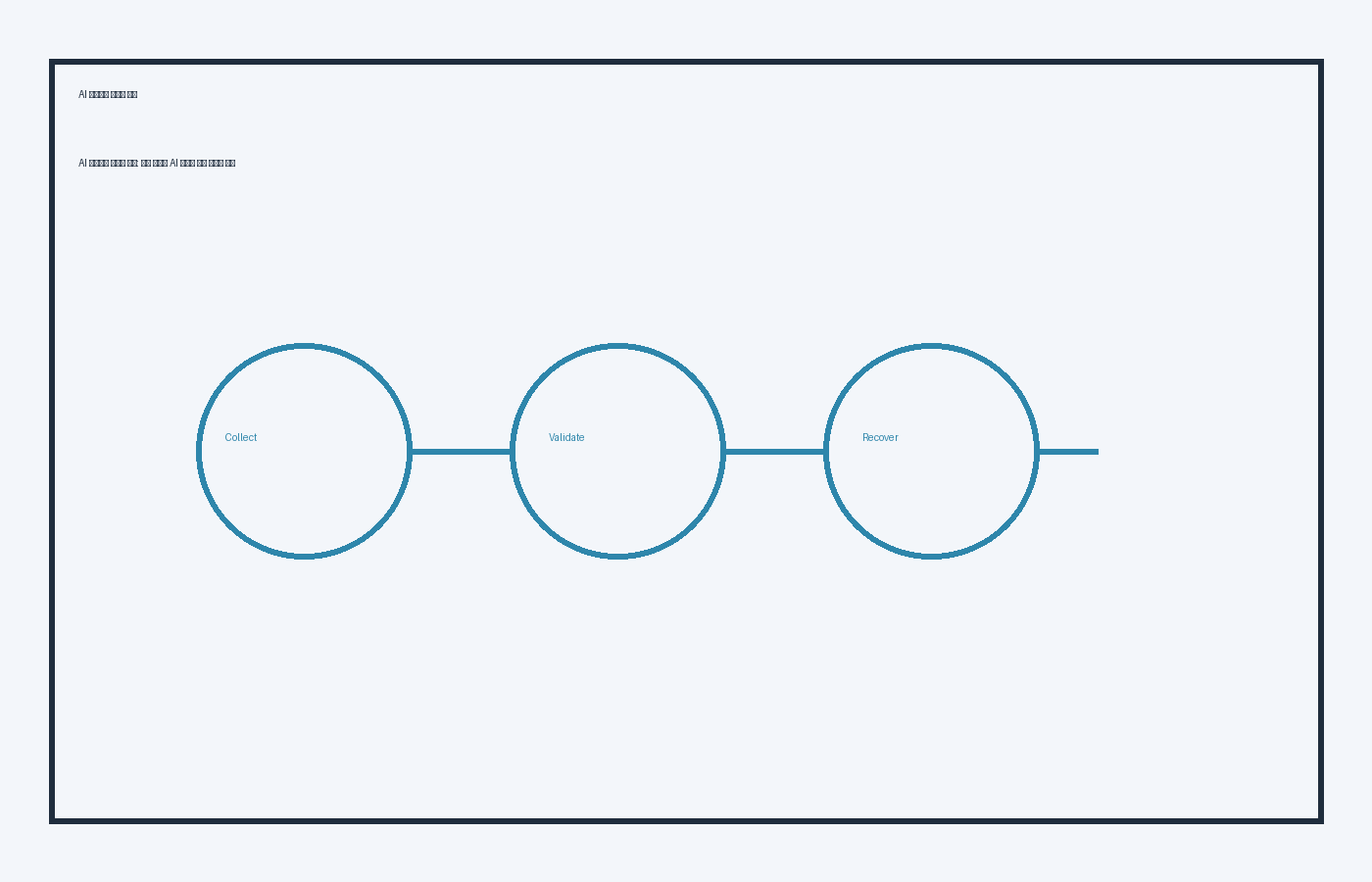

4. Recovery Path: 재시도, 대체 경로, human-in-the-loop

신뢰성은 실패 이후에 결정된다. 실패를 무시하는 시스템은 신뢰성을 잃고, 실패를 숨기는 시스템은 더 빠르게 무너진다. Recovery design is the true reliability design. 복구는 단일 행동이 아니라 경로 설계다. 경로 설계는 적어도 세 가지 레이어로 나뉜다: 자동 재시도, 대체 경로, 그리고 human-in-the-loop.

자동 재시도는 단순히 “다시 호출”이 아니다. 재시도는 실패 원인을 분류한 후에만 의미가 있다. 입력이 애매했다면 질문을 재구성해야 하고, 모델이 과잉 확신했다면 컨텍스트를 줄여야 한다. Blind retry is just cost amplification. 그래서 재시도는 실패 유형별로 프롬프트를 재작성하는 로직과 결합되어야 한다.

대체 경로는 라우팅의 연장선이다. 고비용 모델로 우회하거나, 제한된 템플릿 답변으로 안전성을 확보하거나, 지식 기반 검색 결과만 제공하는 등 다양한 경로를 만들어야 한다. 이 대체 경로는 사용자 경험을 망치지 않으면서 실패를 관리하는 핵심 장치다. The goal is not to avoid all failures, but to provide a graceful degradation.

human-in-the-loop는 마지막 안전망이다. 하지만 여기서 중요한 것은 “사람에게 넘긴다”가 아니라 “사람이 처리 가능한 형태로 넘긴다”다. 즉, 에이전트는 문제 요약, 실패 원인, 시도한 접근을 정리해 전달해야 한다. 그렇지 않으면 사람의 비용이 폭증하고, 복구 루프는 막혀 버린다.

복구 경로는 운영팀의 실행 루프와 연결된다. 실패를 기록하고, 복구로 이어지는 평균 시간을 측정하며, 복구 후 재발 방지 규칙을 업데이트한다. Recovery is a learning loop. 이 학습 루프가 없다면 복구는 응급 처치에 불과하다.

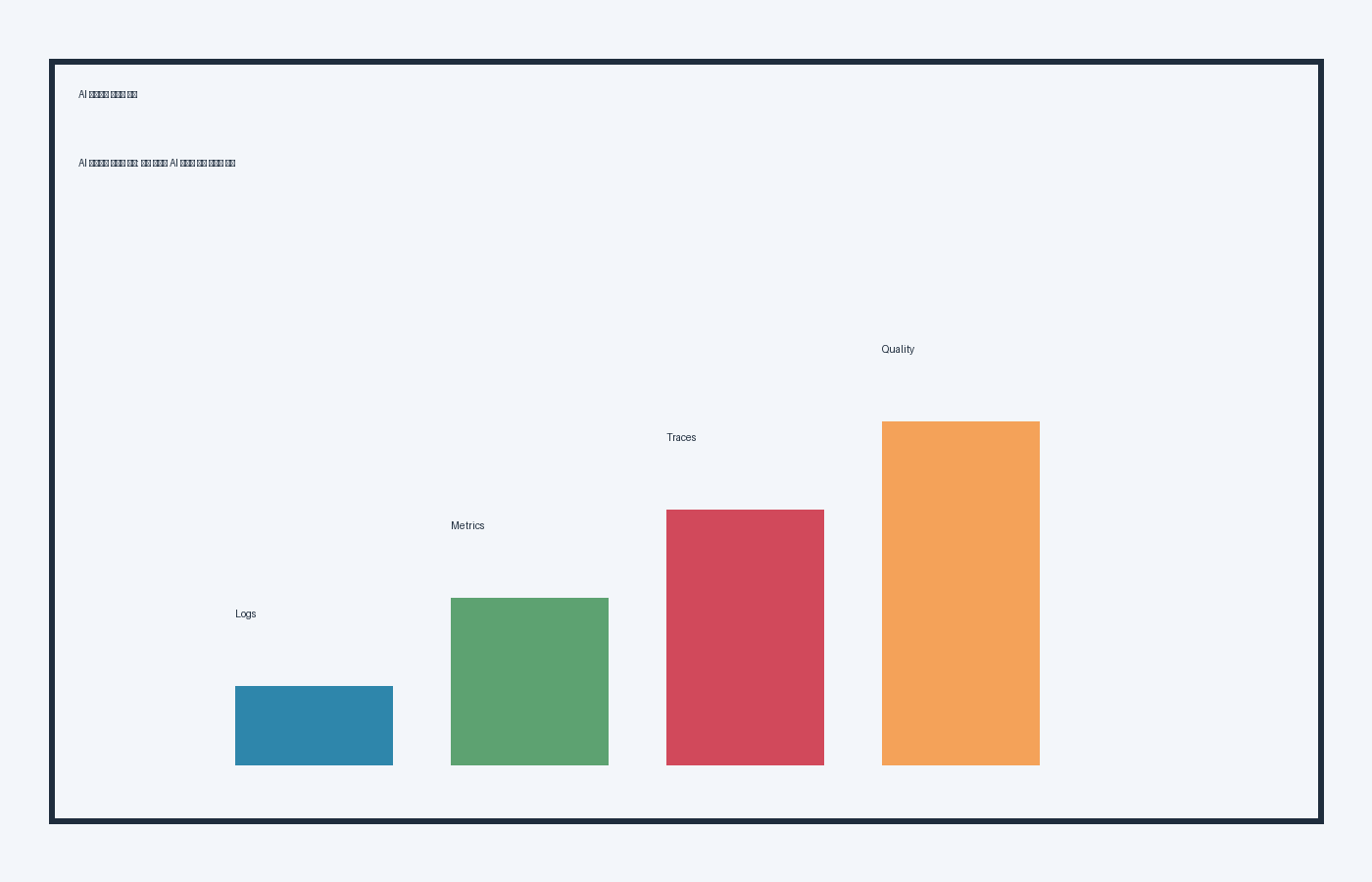

5. Observability Loop: 신뢰를 측정하고 개선으로 연결하기

관측성은 신뢰성을 증명하는 수단이 아니라, 신뢰성을 만드는 수단이다. Observability turns invisible failure into actionable signals. 운영팀이 볼 수 없는 것은 개선할 수 없다. 따라서 관측성 설계는 “어떤 실패가 중요한가”를 정의하는 일이다.

핵심 지표는 세 가지 축을 가져야 한다. 첫째, 품질 지표(정확도, 만족도, 재질문 비율). 둘째, 비용 지표(요청당 비용, 재시도 비용, 라우팅 비용). 셋째, 안전 지표(정책 위반 비율, 가드레일 트리거율). 이 세 축을 한 화면에 놓아야 실제 의사결정이 가능하다. If quality improves while cost doubles, 신뢰성은 오히려 하락한다.

관측성의 또 다른 핵심은 trace-first 설계다. 한 번의 실패를 추적할 수 없으면, 실패는 데이터가 아니라 소문이 된다. 그래서 모든 응답에는 trace id가 있어야 하고, trace는 프롬프트 버전, 모델 버전, 검색 결과, 정책 적용 여부를 연결해야 한다. 이렇게 해야 “왜 실패했는가”를 추적할 수 있다.

관측성 루프는 알림과 연결된다. 알림 설계는 “과잉 알림”과 “무알림” 사이의 균형이다. 실패율이 일정 임계치를 넘으면 알림을 보내되, 그 알림이 직접적인 행동으로 이어지도록 설계해야 한다. Alerts should map to playbooks. 플레이북이 없다면 알림은 소음이 된다.

마지막으로 관측성 루프는 월간/분기 리뷰와 연결되어야 한다. 신뢰성은 장기 지표에서 드러난다. 단기 지표만 보면 운영은 반응형이 되고, 장기 지표가 있어야 선제적 개선이 가능하다. This is where reliability becomes strategy, not just operations.

6. Long-run System: 장기 워크플로와 지식 누적

신뢰성은 단기적인 품질 관리가 아니라 장기적인 워크플로 설계다. 장기 워크플로의 핵심은 지식 누적과 의사결정의 일관성이다. 에이전트 시스템이 성장할수록, 실패 패턴은 반복된다. 반복되는 실패를 자동으로 감지하고, 정책과 프롬프트를 갱신하는 루프가 필요하다. This is the difference between a reactive system and a self-improving system.

장기 워크플로를 설계할 때 중요한 것은 “결정 기록”이다. 어떤 프롬프트 변경이 성공적이었는지, 어떤 라우팅 정책이 비용을 줄였는지, 어떤 가드레일 변경이 품질을 낮췄는지 기록해야 한다. Decision logs are not bureaucracy; they are training data for operations.

또한 장기 워크플로는 조직의 역할 분리를 요구한다. 운영팀은 신뢰성 지표를 관리하고, 모델팀은 품질 개선을 담당하며, 제품팀은 사용자 경험을 설계한다. 이 세 팀이 공통 지표를 공유하지 않으면 신뢰성은 조각난다. Common metrics create shared accountability.

마지막으로, 장기 워크플로는 “반복 가능한 개선”을 목표로 한다. 한 번의 문제 해결이 아니라, 같은 문제를 두 번 해결하지 않는 구조가 필요하다. 이를 위해서는 실패가 발생할 때마다 정책과 프롬프트가 업데이트되고, 그 업데이트가 관측 지표에 반영되며, 다음 분기 리뷰에서 재평가되는 구조가 있어야 한다. The loop must close.

신뢰성 설계는 결국 운영의 디자인이다. 에이전트의 성능이 아니라, 실패를 다루는 시스템이 신뢰를 만든다. failure budget, confidence routing, guardrail, recovery, observability, long-run workflow. 이 다섯 가지는 별개가 아니라 하나의 설계 언어다. 이 언어를 운영팀이 공유할 때, 에이전트는 단순한 기능을 넘어 신뢰 가능한 서비스가 된다.

Tags: PromptSystem, 프롬프트엔지니어링, 에이전트운영, ContextBudgeting, 가드레일, QualityGate, Observability, PromptOps, 장기워크플로, 에이전트복구

7. 운영 시나리오: 신뢰성을 체감하게 만드는 실제 흐름

가장 현실적인 방식은 시나리오 기반 설계다. 예를 들어, 고객 문의 자동 응답 에이전트를 운영한다고 가정해보자. 평상시에는 low-risk 문의가 대다수라 경량 모델로 처리해도 문제 없다. 그러나 이벤트 기간에는 민감한 문의와 금전 관련 요청이 급증한다. 이때 failure budget을 사전에 초과할 가능성이 높아진다. 따라서 이벤트 기간에는 confidence routing의 기준을 강화하고, 민감도 스코어가 일정 수준 이상이면 고성능 모델 또는 human-in-the-loop로 전환해야 한다. This is how routing protects reliability during demand spikes.

또 다른 시나리오는 데이터 드리프트다. 제품 정책이 바뀌면 답변의 맥락이 달라져야 한다. 관측성 지표에서 “재질문 비율”이 급증하면, 이는 답변이 최신 정책과 불일치할 가능성을 의미한다. 이때는 단순히 프롬프트를 수정하는 것이 아니라, 정책 문서의 버전과 답변의 버전을 연결하고, 이전 버전 답변이 얼마나 남아 있는지 확인해야 한다. Drift 대응은 prompt edit가 아니라 knowledge refresh 설계다.

세 번째 시나리오는 비용 급증이다. 모델 비용이 갑자기 상승하면 서비스 수익성을 무너뜨릴 수 있다. 이때 운영팀은 “비용을 줄이기 위한 프롬프트 단축”을 떠올리기 쉽지만, 이는 신뢰성을 악화시킬 위험이 있다. Instead, enforce scope control and reduce retrieval breadth first. 불필요한 문서 검색을 줄이고, 실패 가능성이 높은 요청은 일찍 fallback으로 전환한다. 비용 절감은 품질을 희생하는 것이 아니라, 리스크를 선별하는 방식으로 해야 한다.

마지막 시나리오는 정책 위반 리스크다. 예를 들어 의료 관련 답변에서 금지된 표현이 발생하면, 이는 신뢰성을 넘어 법적 리스크로 확장된다. 이때 가드레일은 단일 룰이 아니라 복합 룰이어야 한다. 출력 검사 단계에서 금칙어를 탐지하고, 정책 위반 가능성이 있는 문장은 자동 재작성하며, 반복되는 패턴은 프롬프트 레벨에서 차단한다. The system should learn which failure patterns recur and block them early.

8. 신뢰성 문서화: 운영 팀을 위한 언어 만들기

운영팀이 신뢰성 설계를 유지하려면 문서화가 필요하다. 문서화는 보고서가 아니라 “언어의 공유”다. 예를 들어 failure budget이 2%라고 정의했을 때, 그 2%는 어떤 유형의 실패를 포함하는가? 재시도 후에도 실패한 건수인가, 초기 실패만 포함하는가? 이러한 정의가 명확하지 않으면 지표는 의미를 잃는다. A metric without a shared definition becomes noise.

문서화의 또 다른 목적은 인수인계다. 운영 인력이 바뀌면 정책과 가드레일이 흔들린다. 이를 막기 위해서는 정책 변경 기록, 라우팅 기준, 복구 경로, 알림 기준을 명시적으로 남겨야 한다. 특히 “왜 이 기준을 선택했는가”를 기록하는 것이 중요하다. 이유가 기록되지 않은 기준은 쉽게 삭제되거나 무시된다.

문서화는 시스템의 신뢰성만이 아니라 조직의 신뢰성까지 높인다. 동일한 기준을 반복적으로 적용할 수 있어야만, 운영은 개인의 경험이 아니라 조직의 자산이 된다. Documented reliability is institutional reliability. 이 원칙은 장기 워크플로를 안정시키는 핵심이다.

9. 결론: 신뢰성은 설계되는 것이다

에이전트 신뢰성은 모델 성능의 부산물이 아니다. 그것은 운영 설계의 결과다. failure budget으로 실패를 예산화하고, confidence routing으로 위험을 분산하고, guardrail로 실패의 형태를 제한하며, recovery path로 실패 이후를 설계하고, observability로 개선 루프를 닫는다. 그리고 장기 워크플로와 문서화로 이 모든 것을 지속 가능하게 만든다. Reliability is not a feature; it is a discipline.

이 설계 언어를 팀이 공유하면, 에이전트는 단순한 자동화가 아니라 신뢰 가능한 서비스가 된다. 신뢰는 시간이 걸려 쌓이지만, 시스템이 올바르게 설계되어 있다면 신뢰는 복리처럼 쌓인다. The best reliability strategy is the one you can sustain for years.

추가로, 신뢰성 설계는 사용자 커뮤니케이션과도 연결된다. 실패가 발생했을 때 침묵하면 신뢰는 빠르게 깨진다. 반대로, 실패 원인과 복구 계획을 투명하게 공유하면 신뢰는 유지된다. This is why incident communication is part of reliability. 운영팀은 기술적 복구뿐 아니라 커뮤니케이션 복구를 함께 설계해야 한다.

또한 신뢰성은 “속도와의 트레이드오프”로만 이해되면 안 된다. 잘 설계된 routing과 가드레일은 오히려 평균 응답 속도를 개선한다. 위험한 요청을 빠르게 분리하면, 안전한 요청은 더 빠르게 처리된다. 즉, 신뢰성과 속도는 충돌하는 목표가 아니라 올바른 분산 전략으로 함께 달성할 수 있는 목표다. Smart routing makes reliability faster, not slower.

마지막으로, 신뢰성은 채널 확장 시 더 중요해진다. API를 외부 파트너에게 제공하거나, 여러 언어로 서비스를 확장할 때, 동일한 신뢰성 기준이 유지되어야 한다. 이를 위해서는 언어별 프롬프트 차이를 최소화하고, 공통 정책 레이어를 두어 일관성을 보장해야 한다. Consistency across channels is the true test of reliability.

실행 팁을 하나 더 덧붙이면, 신뢰성 지표를 “권한 지표”로 연결하라. 예를 들어 운영팀이 실패율이 특정 임계치를 넘기면 자동으로 라우팅 정책을 변경할 수 있는 권한을 갖게 한다. 이는 운영 속도를 크게 높인다. 권한이 늦으면 신뢰성은 늦는다. Empowered operations is reliable operations.

그리고 조직 내 교육도 신뢰성 설계의 일부다. 에이전트 운영에 참여하는 사람이 “실패는 나쁜 것”이라고만 이해하면, 실패는 숨겨지고 누적된다. 실패를 공개하고, 실패를 개선으로 연결하는 문화가 있어야 한다. 이 문화가 없으면 아무리 좋은 가드레일도 지속되지 못한다. Culture is the hidden layer of reliability.

마지막으로 “신뢰성 회고”를 루틴화하라. 월 1회라도 실패 사례를 정리하고, 어떤 정책이 효과적이었는지 기록한다면 운영 품질은 꾸준히 개선된다. This review should include a small list of decisions: what to keep, what to change, and what to sunset. 회고는 데이터보다 결정이 남는 자리여야 한다. 결정이 남으면 신뢰성이 남는다.

요약하면, 신뢰성은 “기술적 성능”이 아니라 “운영적 약속”이다. 이 약속이 지켜질 때, 사용자는 시스템을 믿고 다시 돌아온다. Trust is a habit built by consistent operations. 그리고 이 습관이 쌓이면, 에이전트는 조직의 핵심 자산이 된다.

이 글의 핵심은 단순하다. 실패를 관리하라, 복구를 설계하라, 그리고 기록을 남겨라. 이 세 가지가 반복될 때 신뢰성은 자연스럽게 따라온다. Reliability follows discipline.

지속 가능한 신뢰는 단기 성과보다 긴 호흡의 운영에서 나온다.

That is the real competitive advantage for AI operations.

End.

지속하라.