에이전트 관측성 운영: Trace-to-Decision 매핑으로 신뢰를 고정하는 방법

AI 에이전트가 복잡한 워크플로를 따라 움직이는 시대에는 ‘무엇이 일어났는지’를 뒤늦게 추적하는 것만으로는 충분하지 않습니다. 사용자는 결과가 나온 이유를 알고 싶어 하고, 운영 팀은 비용과 품질이 어떤 경로를 통해 변했는지를 설명해야 합니다. 그래서 관측성은 단순한 모니터링을 넘어 ‘결정의 근거’를 연결하는 체계가 되어야 합니다. 이번 글은 에이전트 관측성 운영을 Trace-to-Decision 매핑 관점에서 정리하고, 실제 운영에 필요한 설계와 실행 단계를 깊게 다룹니다. 읽는 동안 “관측성은 로그가 아니라 언어”라는 관점을 가져보면, 이후의 운영 전략이 훨씬 선명하게 보일 것입니다.

In modern agent systems, the key is not just visibility but accountability. A trace that only shows API latency is not enough; you need to connect the trace to the decision graph, the prompt version, and the policy that allowed a tool call. When a failure occurs, we should be able to answer: what did the model see, what options were considered, what rules were applied, and how did that choice impact cost and user experience. This article aims to create a blueprint for that level of observability, balancing engineering reality with operational clarity and avoiding the trap of noisy telemetry.

목차

- 관측성의 범위 재정의: Trace보다 Decision

- 데이터 수집 설계: Span, Event, Context의 연결 구조

- 지표와 SLO: 품질·비용·속도의 삼각 균형

- 사고 대응과 운영 리듬: Runbook과 학습 루프

- 거버넌스와 프라이버시: 책임 있는 관측성

- 실전 도입 로드맵: 90일 적용 전략

1. 관측성의 범위 재정의: Trace보다 Decision

에이전트 시스템에서의 관측성은 단순히 호출 시간을 재는 것이 아니라, 왜 그 호출이 필요했는지를 남기는 일입니다. 에이전트는 도구를 고르고 순서를 정하는 작은 의사결정을 수십 번 반복하며, 이 결정들의 누적이 최종 품질을 만듭니다. 따라서 관측성의 범위는 “요청-응답”이 아니라 “결정-결과”로 이동해야 합니다. 예를 들어 사용자의 질문을 분석해 도구 A와 B 중 하나를 선택했다면, 그 선택의 근거(프롬프트 버전, 정책 규칙, 최근 실패 기록)가 함께 저장되어야 합니다. 그래야 운영자는 단순 오류보다 깊은 구조를 이해하고 개선할 수 있습니다. 이러한 구조가 없으면, 문제는 반복적으로 발생하고 해결은 늘 임시방편이 됩니다.

결정의 범위를 정의하는 것도 중요합니다. 의사결정은 “의도 분류”, “도구 선택”, “도구 호출 파라미터”, “응답 톤 선택” 등 다양한 단계에서 발생합니다. 이 단계들을 모두 같은 수준으로 기록하면 분석이 어려워지기 때문에, 결정의 중요도에 따라 레벨을 분리하는 것이 좋습니다. 예를 들어 중요한 결정은 반드시 저장하고, 사소한 결정은 샘플링하거나 요약하는 식입니다. 이렇게 계층화된 결정 로그는 데이터 비용을 줄이면서도 운영에 필요한 핵심 정보를 남깁니다. 결과적으로 관측성은 ‘모든 로그를 보는 것’이 아니라 ‘필요한 로그를 빠르게 찾는 능력’이 됩니다.

From an operational viewpoint, this means defining a “decision schema.” Each decision should include the intent label, candidate set, selection logic, confidence, and downstream impact. When you aggregate these decisions, you can see patterns: which intents are most expensive, which tools are misrouted, and where the model’s uncertainty spikes. Over time, this becomes a map of systemic behavior rather than a list of incident tickets. The shift is subtle but critical: we stop asking “what happened?” and start asking “why did it make sense at the time?” That shift turns observability into a strategic asset.

2. 데이터 수집 설계: Span, Event, Context의 연결 구조

Trace-to-Decision 관측성을 구현하려면 스팬과 이벤트만으로는 부족합니다. 핵심은 Context 레이어를 구조화하는 것입니다. Context는 모델이 본 입력, 정책 룰의 적용 결과, 사용자 세그먼트, 그리고 최근의 실패 기록 같은 상태 정보를 포함합니다. 이 정보를 표준화된 구조로 저장하면, 특정 문제의 근본 원인을 빠르게 찾을 수 있습니다. 예를 들어 “고객 이탈”을 유발한 응답이 어느 정책 변경 이후 급증했다면, 그 변경이 담긴 Context 버전만 추적해도 원인 분석이 빨라집니다. 또한 Span에는 “결정 ID”를 넣어 서로 다른 시스템(로그, 품질 평가, 비용 추적)이 동일한 결정 단위를 공유하게 만들어야 합니다.

데이터 품질 관점에서도 Context는 핵심입니다. 같은 오류가 반복될 때, 입력 텍스트만 봐서는 원인을 찾지 못하는 경우가 많습니다. 하지만 그 시점에 적용된 정책 버전, 안전 필터 강도, 또는 모델 라우팅 기준을 함께 보면, 문제는 구조적으로 보이기 시작합니다. 데이터 수집은 그래서 단순한 저장이 아니라 “연결성 확보”의 문제입니다. 또한 로그 수집 비용이 커질수록 샘플링 전략이 중요해지며, 오류 발생 구간이나 고비용 구간은 반드시 샘플링 비율을 높이는 적응형 샘플링이 필요합니다. 이는 비용을 줄이면서도 중요한 신호를 놓치지 않는 방법입니다.

결정 ID는 시스템 전반에서 공유되어야 합니다. API 게이트웨이, 에이전트 오케스트레이터, 프롬프트 저장소, 평가 파이프라인이 같은 키를 사용하면, 서로 다른 팀이 같은 사건을 다른 각도에서 분석할 수 있습니다. 이 구조는 결국 조직의 협업 속도를 높여줍니다. 또한 저장소는 단순 로그 저장소가 아니라, 검색 가능한 의사결정 레이크로 설계되어야 합니다. “policy_v17에서 tool_X가 실패한 사례” 같은 질의를 빠르게 실행할 수 있어야 운영 팀의 대응 속도가 유지됩니다.

지표를 실시간으로 제공하려면 데이터 지연을 줄이는 설계가 필요합니다. 배치 처리만으로는 사고가 발생한 후 몇 시간 뒤에야 원인을 찾게 되고, 이는 사용자 경험에 큰 손실을 남깁니다. 그래서 핵심 의사결정 로그는 스트리밍 파이프라인으로 전달하고, 요약 지표는 짧은 시간 간격으로 업데이트되는 구조가 좋습니다. 이 방식은 실시간 알림과 함께 효과가 극대화되며, 특히 비용 급등이나 품질 급락을 빠르게 감지할 수 있습니다.

Technically, this is an event graph. Each node is a decision or tool call, and edges represent dependency. If your agent delegates tasks to sub-agents, the graph needs a parent-child link so that cost and quality can be rolled up. That allows “decision-level” cost attribution, which is more actionable than raw token counts. When a decision chain is too long, the system can flag it as a structural smell, similar to how software engineers flag deep call stacks. By designing the data model this way, you make the system explainable without drowning in logs, and you gain the ability to query by intent, policy, and tool outcome.

3. 지표와 SLO: 품질·비용·속도의 삼각 균형

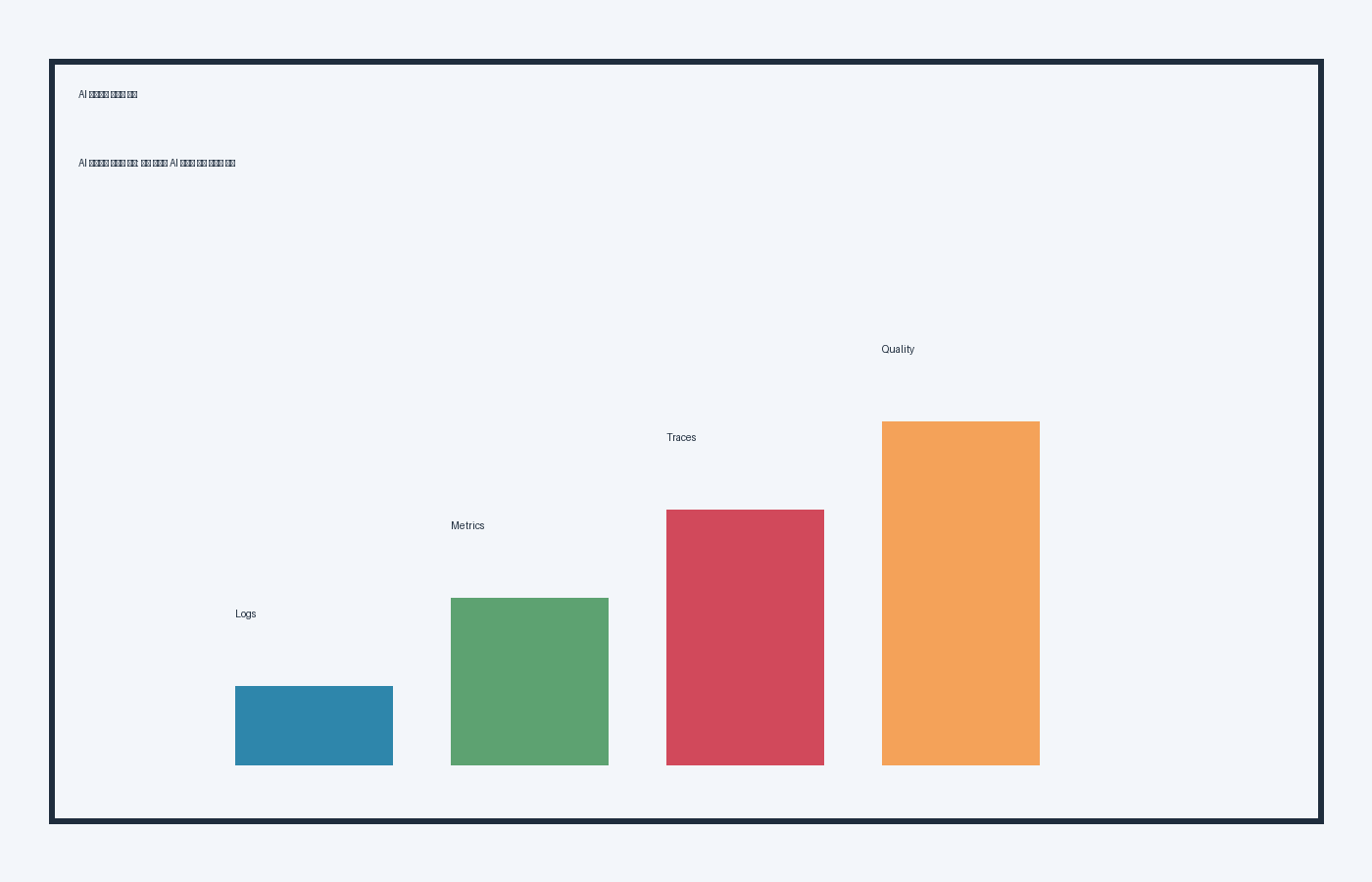

관측성의 목적은 행동을 바꾸는 것입니다. 따라서 지표는 ‘실행 가능한 질문’을 촉발하도록 설계되어야 합니다. 예를 들어 “응답 시간 평균”은 관측성의 시작일 뿐이고, 실제로는 “결정 단위당 지연”이나 “도구 호출당 실패 비율”처럼 원인에 가까운 지표가 필요합니다. 품질은 고객 만족도나 평가 점수로 단순화되기 쉽지만, 에이전트 환경에서는 “정확도, 일관성, 안전성”을 분리해서 보고해야 합니다. 특히 안전성은 정책 위반뿐 아니라 “모델이 알지 못하는 영역에 대해 얼마나 빠르게 불확실성을 인정했는지”로 정의할 수 있습니다.

모델 품질을 안정적으로 관리하려면 평가 하네스가 필요합니다. 실시간 트래픽에서만 품질을 관찰하면, 작은 변화가 큰 사고로 연결될 때까지 감지하지 못할 수 있습니다. 정기적으로 합성 테스트 세트를 돌리고, 결정별 결과를 비교하는 체계를 만들면, 품질 저하를 조기에 발견할 수 있습니다. 이때 중요한 것은 평가 결과를 정책 버전과 묶어서 보는 것입니다. 같은 모델이라도 정책이 달라지면 품질 체감이 바뀌기 때문에, 단순 모델 버전 관리만으로는 부족합니다. 관측성은 결국 “평가-정책-결정”의 삼각 구조로 완성됩니다.

비용 지표 역시 세밀해야 합니다. 총 토큰 비용은 중요하지만, 실제 운영에서는 “의사결정 유형별 비용”이나 “도구 호출당 평균 비용”이 훨씬 유용합니다. 예를 들어 특정 도구가 주당 비용의 40%를 차지한다면, 그 도구를 대체하거나 캐시 전략을 강화하는 것이 가장 빠른 비용 절감 경로가 됩니다. 또한 비용과 품질의 상관 관계를 보여주는 대시보드를 만들어야 합니다. 이것이 있어야 비용 절감이 품질 저하를 유발하는지, 아니면 오히려 불필요한 비용을 제거하는지를 확인할 수 있습니다.

이상 징후 탐지도 필수입니다. 단순한 임계값 알림은 오탐이 많기 때문에, 의사결정 유형별 정상 분포를 학습하고 변동 폭을 추적하는 방식이 효과적입니다. 예를 들어 특정 의도에서만 실패율이 급증한다면, 그 의도에 대한 정책 변경이 원인일 가능성이 높습니다. 관측성 데이터는 여기서 “원인에 가까운 신호”를 제공해야 하며, 그 신호가 있는 조직은 대응 속도가 압도적으로 빨라집니다.

Change management matters as well. When you deploy a new policy or prompt version, you should expect a measurable shift in decision distribution. A good observability system provides a “before/after” comparison at the decision layer, not just the overall success rate. This lets you validate whether the change improved the intended intent classes or caused collateral damage elsewhere. Over time, this creates a disciplined release culture rather than a series of reactive fixes.

In practice, your SLO should be multi-layered. One layer tracks user-facing latency and success, another layer tracks decision accuracy, and a third layer tracks resource usage. This layered SLO structure allows trade-offs to be explicit: if we allow more tool calls, quality may rise but cost increases. The goal is to make these trade-offs visible and deliberate, not accidental. When an SLO is breached, the response should point to the decision class or policy version that caused it, enabling targeted remediation instead of global rollback. This prevents overreaction and preserves learning momentum.

4. 사고 대응과 운영 리듬: Runbook과 학습 루프

관측성은 사고 대응의 속도를 결정합니다. 그러나 더 중요한 것은 반복되는 문제를 줄이는 운영 리듬입니다. 에이전트 시스템은 매일 조금씩 변하기 때문에, 운영 팀은 “주간 분석”과 “월간 리뷰” 같은 정기 리듬을 가져야 합니다. 주간 분석에서는 의사결정 그래프의 변화를 살피고, 특정 도구 호출이 늘어난 이유를 해석해야 합니다. 월간 리뷰에서는 정책 룰과 프롬프트 버전의 변화를 품질과 비용 추세와 연결해봅니다. 이러한 리듬이 없으면 관측성 데이터는 단지 쌓이는 로그일 뿐입니다.

운영 리듬이 작동하려면 대시보드가 읽기 쉬워야 합니다. “전체 성능”과 “결정 단위 성능”을 동시에 보여주는 구조가 필요합니다. 예를 들어 상단에는 SLA 수준의 지표를 배치하고, 아래에는 의사결정 유형별 히트맵과 비용 분포를 배치합니다. 이렇게 하면 운영 팀은 문제를 “어디서부터” 보기 시작해야 하는지 빠르게 판단할 수 있습니다. 또한 on-call 대응 시에는 단일 알림보다 맥락 중심의 알림이 중요합니다. 예컨대 “도구 X 실패율 3배 증가”와 함께 “해당 결정 유형과 관련된 정책 변경”을 보여주면 대응 속도가 훨씬 빨라집니다.

Operationally, a good runbook is short but precise. It should include how to identify the failing decision class, how to roll back a policy version, and how to capture evidence for later learning. The best runbooks also include a “learning section” that describes what to update in prompts, routing logic, or evaluation tests. This is where observability becomes a feedback loop, not a postmortem archive. The runbook should reference a shared dashboard that shows decision heatmaps, tool error clustering, and cost spikes per intent. Over time, the runbook becomes a living document tied directly to the decision taxonomy.

5. 거버넌스와 프라이버시: 책임 있는 관측성

관측성 강화는 데이터 수집을 늘리기 때문에 프라이버시와 거버넌스가 중요해집니다. 민감한 데이터를 무작정 수집하면 장기적으로 위험이 커집니다. 따라서 결정 단위의 로그에도 최소 수집 원칙을 적용해야 합니다. 예를 들어 원문 입력을 그대로 저장하는 대신, 민감 정보를 마스킹한 요약이나 임베딩 지표만 저장하는 방식이 필요합니다. 또한 정책 결정 로그는 감사(audit) 목적으로 관리할 수 있도록 불변성과 접근 통제가 보장되어야 합니다. 이것이 없으면 관측성은 신뢰를 만드는 대신 신뢰를 깨뜨릴 수 있습니다.

데이터 보관 기간도 중요한 정책입니다. 에이전트가 처리하는 정보는 시간이 지나면 가치가 줄어들고, 보관할수록 리스크가 커집니다. 따라서 보관 기간을 업무 목적에 맞게 정의하고, 기간이 끝나면 자동으로 삭제되도록 해야 합니다. 또한 삭제 프로세스는 기술적으로 신뢰할 수 있어야 하며, 감사 가능하도록 기록이 남아야 합니다. 관측성은 결국 데이터 관리의 문제이기도 하므로, 보안팀과 운영팀이 함께 설계해야 합니다.

Governance is also about intent. You need to be clear about why a piece of data is collected and how long it will be retained. When you can answer these questions, your observability design becomes defensible. A transparent policy makes it easier to gain internal approval and to scale the system across departments. In other words, privacy-first observability is not a constraint; it is a scaling strategy that keeps trust intact while increasing operational clarity.

6. 실전 도입 로드맵: 90일 적용 전략

실전 적용은 90일을 기준으로 설계하는 것이 현실적입니다. 첫 30일은 결정 스키마와 데이터 모델을 정의하고, 핵심 도구 호출에 결정 ID를 심는 작업에 집중합니다. 두 번째 30일에는 지표와 대시보드를 구성하고, SLO와 알림 기준을 만들며, 운영 팀과 공유하는 언어를 통일합니다. 마지막 30일에는 사고 대응 루프와 정기 리뷰 리듬을 확립하고, 거버넌스 정책을 문서화합니다. 이 과정에서 가장 중요한 것은 “조금씩 확장”하는 전략입니다. 모든 것을 한 번에 완성하려는 시도는 실패 확률이 높습니다.

운영 성숙도를 높이기 위해서는 교육도 필요합니다. 에이전트의 관측성은 데이터 분석 능력과 운영 감각이 동시에 요구되기 때문에, 운영팀이 지표를 해석하고 행동으로 옮기는 역량을 키워야 합니다. 또한 경영진이 관측성의 가치를 이해해야 투자와 우선순위가 유지됩니다. 로드맵은 단순한 기술 계획이 아니라 조직 변화 계획이기도 하며, 그 변화가 성공해야만 관측성 체계가 지속됩니다.

Finally, make the roadmap visible. When stakeholders see the timeline and the rationale, they are more likely to support the system. Observability is not just a technical upgrade; it is a product capability. Once you can explain decisions, you can improve them, and that is the heart of reliable agent operations. A visible roadmap also creates accountability and ensures that observability remains a first-class priority rather than a temporary experiment.

Tags: 관측성,에이전트운영,trace-to-decision,decision-logging,metric-design,agent-telemetry,incident-response,governance,quality-loop,cost-visibility