AI 에이전트 신뢰성 설계: 실패를 다루는 구조가 신뢰를 만든다

AI 에이전트는 “잘 되는 날”보다 “망가지는 날”에 평가된다. 사용자 경험은 작은 오류에 민감하고, 운영팀은 반복되는 장애에 지친다. 그래서 신뢰성 설계는 기능 개발이 아니라 운영 생존 전략이다. 이 글은 AI 에이전트 신뢰성 설계를 체계적으로 만드는 방법을 다룬다. 안정적인 서비스, 예측 가능한 동작, 빠른 복구를 위한 구조적 접근을 소개한다.

목차

- 신뢰성이란 무엇이고 왜 AI 에이전트에 치명적인가

- Failure Mode Inventory: 실패의 언어를 표준화하기

- Resilience Architecture: 복원력 구조 설계

- Confidence Calibration: 자신감의 측정과 교정

- Guardrail Design: 정책과 제약을 설계로 옮기기

- Incident Response Loop: 장애 학습 루프 구축

- Reliability Metrics: 측정 없이는 개선도 없다

- 운영 조직과 책임 모델

- 실전 적용 로드맵

- 마무리

신뢰성이란 무엇이고 왜 AI 에이전트에 치명적인가

신뢰성은 단순히 “잘 동작한다”가 아니다. 신뢰성은 예측 가능성, 일관성, 복구 가능성의 합이다. AI 에이전트는 확률적 시스템이기 때문에 결과가 매번 같지 않다. 그래서 reliability는 기능이 아니라 “운영 약속”에 가깝다. A user trusts the system when it behaves consistently under stress, not only when everything is perfect.

전통 소프트웨어는 입력과 출력의 매핑이 비교적 안정적이다. 반면 에이전트는 컨텍스트, 도구, 데이터 상태, 정책, 그리고 모델의 변동성까지 묶여 있다. 이 복합성은 실패를 “예외 처리”가 아닌 “일상 패턴”으로 만든다. 따라서 신뢰성 설계는 실패를 줄이는 것이 아니라 실패를 관리하고 회복하는 구조를 만드는 일이다.

Failure Mode Inventory: 실패의 언어를 표준화하기

가장 먼저 해야 할 일은 실패를 분류하는 일이다. “잘 안 됨”이라는 표현은 운영을 마비시킨다. 실패는 유형화되어야 원인을 찾을 수 있고, 반복을 막을 수 있다. 예를 들어 다음과 같은 범주를 정의할 수 있다.

1) Context Failure: 잘못된 컨텍스트로 인해 요청이 비틀어지는 문제. 2) Tool Failure: 도구 호출 오류나 레이트 리밋. 3) Policy Failure: 안전 정책 위반. 4) Output Failure: 결과가 불완전하거나 오해를 일으키는 표현. 5) State Failure: 상태가 꼬여서 다음 단계가 잘못 진행되는 문제. These categories become a shared language across engineering, product, and operations.

실패 유형별로 “대표 시나리오”와 “최소 재현 조건”을 남겨두면, 장애 대응의 속도와 품질이 달라진다. 이 단계에서 만든 Failure Mode Inventory는 이후의 테스트 설계와 모니터링에 그대로 반영된다.

Resilience Architecture: 복원력 구조 설계

복원력은 “장애가 발생해도 시스템이 무너져 내리지 않는 구조”다. AI 에이전트에서는 다음과 같은 전략이 자주 쓰인다.

Fallback Strategy: 실패 시 즉시 다른 경로로 전환한다. 예를 들어 도구 호출이 실패하면 단순 요약 모드로 전환하거나, 정책 위반 가능성이 높으면 안전 응답으로 전환한다. 이때 fallback은 “같은 결과를 억지로 만들기”가 아니라 “최소 가치”를 제공하도록 설계해야 한다.

Graceful Degradation: 일부 기능이 실패해도 전체 서비스는 살아 있어야 한다. Tool latency가 늘어날 때는 모델이 도구 없이 추론을 시도하거나, 답변 길이를 줄여 신속하게 응답하는 전략을 적용한다. This is not about hiding the issue; it is about preventing total collapse.

Idempotent Recovery: 같은 요청이 반복되어도 동일한 결과가 나오도록 상태 복구를 설계한다. 에이전트의 상태 머신은 복구 가능한 형태로 저장되어야 한다. 상태가 꼬이면 신뢰는 급격히 떨어진다.

Confidence Calibration: 자신감의 측정과 교정

AI 에이전트는 종종 자신감이 과잉이거나 부족하다. 신뢰성은 “정확성”뿐 아니라 “자신감의 균형”에 달려 있다. Confidence calibration은 확률 점수를 말 그대로 믿을 수 있게 만드는 작업이다.

Calibration은 데이터셋 기반의 통계적 보정부터, 운영 중 feedback loop까지 포함한다. 예를 들어 모델이 높은 자신감을 보인 답변 중 오류가 잦다면, 그 패턴은 신뢰성 붕괴 신호다. You can recalibrate by applying temperature adjustments, threshold gating, or routing critical queries to a stricter model.

또한 사용자에게 “확실하지 않음”을 명시하는 것도 신뢰성을 높인다. 애매한 답변을 확신에 찬 톤으로 말하면 오히려 신뢰가 깨진다. 투명한 uncertainty 표현은 UX에 긍정적 영향을 준다.

Guardrail Design: 정책과 제약을 설계로 옮기기

정책은 문서에만 있으면 무용지물이다. Guardrail은 설계로 구현되어야 한다. 예를 들어 다음과 같은 레이어를 만들 수 있다.

1) Pre-check: 입력에서 위험 요소를 탐지하는 단계. 2) Mid-check: 도구 호출 전에 정책 검사. 3) Post-check: 출력 평가 및 수정. 4) Logging & review: 위험 패턴을 수집하고 정책 업데이트에 반영한다.

These guardrails are not only about safety. They also improve consistency by narrowing the behavior space. When the system knows its boundaries, users feel it is predictable. Guardrails reduce chaos, and predictability is the core of trust.

Incident Response Loop: 장애 학습 루프 구축

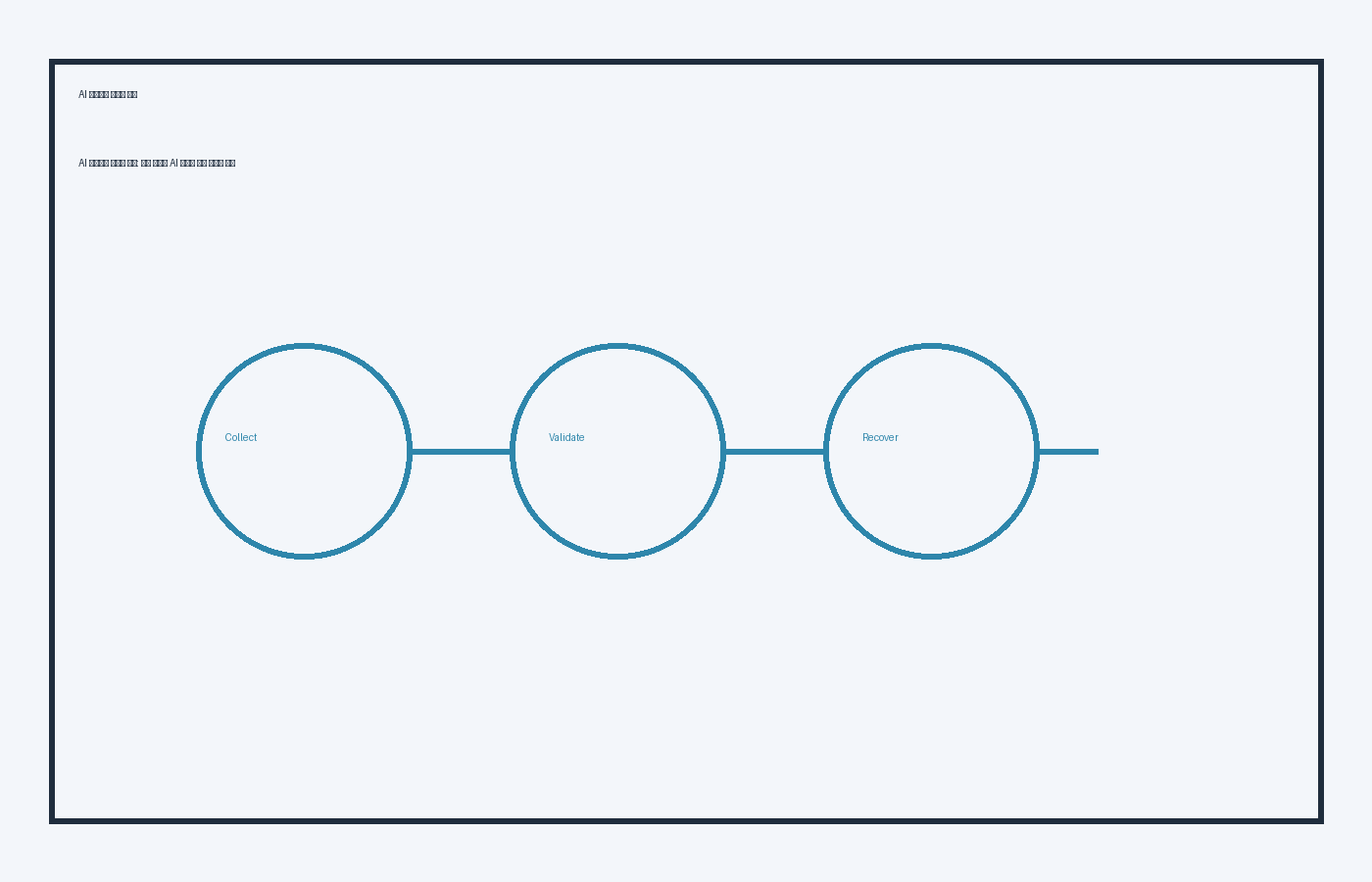

신뢰성 설계는 사고 이후에 완성된다. 장애를 겪고, 분석하고, 시스템을 개선하는 루프를 만들지 않으면 신뢰성은 성장하지 않는다. Incident Response Loop는 다음의 흐름으로 설계할 수 있다.

Trigger → Triage → Fix → Postmortem → Patch. 여기서 중요한 것은 Postmortem의 질이다. “누가 실수했는가”가 아니라 “왜 시스템이 실패하도록 방치되었는가”를 묻는다. This transforms blame into learning.

또한 루프는 기록 기반으로 운영해야 한다. failure patterns, time-to-detect, time-to-recover, 그리고 사용자 영향을 정량화한다. 그래야 개선의 ROI를 명확히 설명할 수 있다.

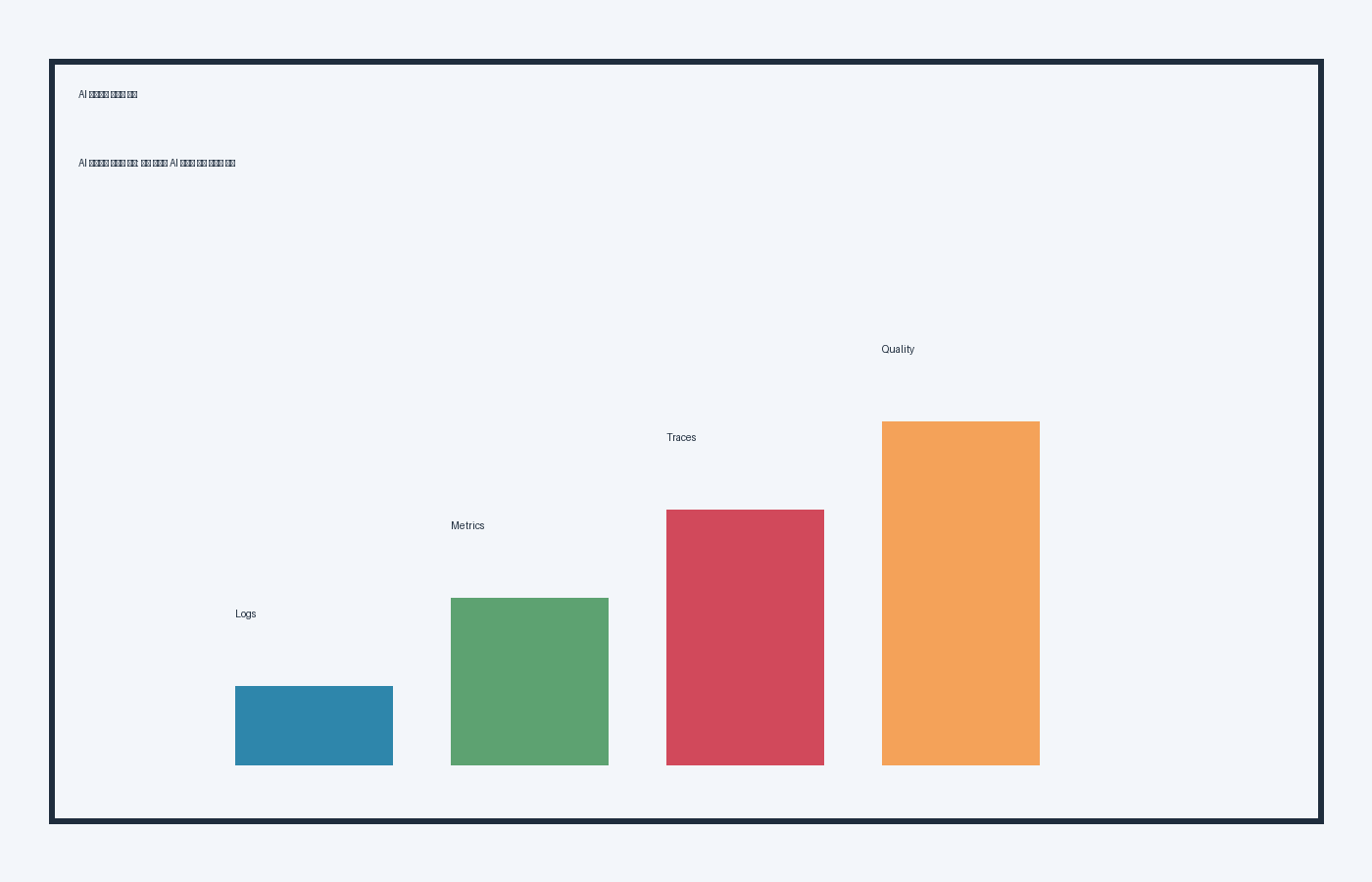

Reliability Metrics: 측정 없이는 개선도 없다

측정 지표 없이는 신뢰성 개선이 불가능하다. AI 에이전트의 신뢰성 지표는 전통적인 SRE 지표와 다르게 설계해야 한다. 예시:

Consistency Rate: 동일 입력에 대한 결과 일관성 비율. Recovery Time: 실패 후 정상 동작까지 걸린 시간. Fallback Success: fallback 경로에서 최소 가치 제공 성공률. Policy Violation Rate: 안전 정책 위반 비율. Confidence Error: 높은 자신감 답변의 오류 비율.

These metrics must be connected to business impact. 예를 들어 “신뢰성 지표가 10% 개선되면 재방문율이 얼마나 상승했는가” 같은 방식으로 연결하면 운영팀의 노력 가치가 명확해진다.

운영 조직과 책임 모델

신뢰성은 팀 구조와도 연결된다. 에이전트가 복잡해질수록 엔지니어링, 운영, 데이터, 정책 팀이 분리될 수밖에 없다. 그래서 책임 모델이 필요하다. who owns reliability? The answer should be explicit.

권장 구조는 “Reliability Champion”과 “Policy Steward”를 두고, 운영 회의에서 신뢰성 지표를 정기적으로 리뷰하는 것이다. 또한 장애 대응 책임을 명확히 해 두면, 장애 발생 시 혼선이 줄어든다.

실전 적용 로드맵

이제 현실적인 적용 로드맵을 제안한다.

1) Failure Mode Inventory 작성 → 2) 초기 Guardrail 설계 → 3) Fallback & Degradation 전략 정의 → 4) Calibration 로직 적용 → 5) Metrics 대시보드 구축 → 6) Incident Response Loop 정착.

이 로드맵은 순차적이지만, 실제 운영에서는 병행이 필요하다. 중요한 것은 “완벽한 설계”보다 “지속 가능한 루프”다. The goal is not perfection; the goal is predictable improvement.

마무리

AI 에이전트 신뢰성 설계는 기술적 설계이면서 운영 철학이다. 실패를 숨기지 말고, 실패를 구조화하자. 복원력은 기능이 아니라 “습관”에서 나온다. Today’s AI systems are dynamic, and trust must be engineered repeatedly, not granted once.

신뢰성이 확보되면, 에이전트는 단순한 도구를 넘어 “믿을 수 있는 동료”로 자리 잡는다. 이 글의 원칙을 기반으로 실패를 두려워하지 않는 운영 구조를 만들길 바란다.

운영 시나리오 예시: 신뢰성 결함을 줄이는 실전 프레임

가상의 예시로 고객지원 에이전트를 생각해보자. 사용자는 “환불 규정”을 묻는데, 에이전트는 오래된 정책을 인용한다. 이것은 Context Failure와 Policy Failure가 결합된 사례다. 해결책은 컨텍스트 최신화와 정책 룰셋 동기화를 동시에 설계하는 것이다. For instance, versioned policy snapshots can prevent the model from mixing outdated rules with new ones.

또 다른 상황은 결제 API 호출이 지연되는 경우다. 에이전트는 도구 호출을 여러 번 반복하며 사용자에게 혼란스러운 메시지를 보낸다. 이때는 Graceful Degradation이 필요하다. “현재 결제 확인이 지연되고 있으며, 2분 내 재시도하겠다” 같은 안내를 표준화하면 불확실성을 줄일 수 있다. Users prefer a clear status over a false sense of completion.

이러한 시나리오를 주기적으로 리뷰하고, Failure Mode Inventory에 반영하면 신뢰성은 점진적으로 강화된다. 운영팀이 실제 실패 패턴을 지속적으로 기록하고, 설계팀이 그 기록을 구조화하는 루프가 핵심이다.

Tags: reliability-ops, failure-mode-library, recovery-playbook, fallback-strategy, confidence-calibration, guardrail-design, incident-response, resilience-metrics, trust-score, robustness-testing